Merhaba, dostlar, TechCrunch’ın düzenli yapay zeka bültenine hoş geldiniz. Her Çarşamba bu bülteni e-posta kutunuza almak isterseniz, buradan kaydolabilirsiniz.

Haber

OpenAI’nin yeni ürünü olan o1 hakkında ilk tepkiler: Max, o1 hakkında yapay zeka araştırmacıları, startup kurucuları ve risk sermayedarlarından ilk izlenimleri aldı ve modeli kendisi test etti.

Altman güvenlik komitesinden ayrılıyor: OpenAI CEO’su Sam Altman, o1 gibi modellerin güvenliğini inceleyen komiteden istifa etti, muhtemelen tarafsız davranmayacağı endişeleri üzerine.

Slack bir ajans merkezine dönüşüyor: Ana şirketi Salesforce’un yıllık Dreamforce konferansında, Slack toplantı özetlerini yapay zeka tarafından oluşturulan özellikler ve görüntü oluşturma ve yapay zeka destekli web aramaları için araçlarla entegrasyonlar dahil olmak üzere yeni özellikler duyurdu.

Google AI görüntülerini işaretlemeye başlıyor: Google, Google Arama’yı değiştirmek için değişiklikler yapmayı planladığını söylüyor ve sonuçlardaki hangi görüntülerin yapay zeka tarafından üretildiğini veya yapay zeka araçları tarafından düzenlendiğini daha açık bir şekilde belirtecek.

Mistral ücretsiz bir seviye başlatıyor: Fransız yapay zeka startup’ı Mistral, geliştiricilerin startup’ın yapay zeka modellerini ayarlamasına ve test uygulamaları oluşturmasına izin vermek için yeni bir ücretsiz seviye başlattı.

Snap bir video üreteci başlatıyor: Snapchat, Salı günü düzenlenen yıllık Snap Partner Zirvesi’nde, seçilen yaratıcılara metin ipuçlarından AI videoları oluşturmalarına ve yakında görüntü ipuçlarından da AI videoları oluşturmalarına izin verecek yeni bir AI video üretim aracını duyurdu.

Intel büyük bir yonga anlaşması imzalıyor: Intel, AWS ile işbirliği yaparak Intel’in 18A yonga üretim sürecini kullanarak bir AI yongası ortaklığı geliştireceğini söylüyor. Şirketler, anlaşmayı “çok yıllık, çok milyar dolarlık bir çerçeve” olarak tanımladı ve ilave yonga tasarımlarını da içerebileceğini belirtti.

Oprah’ın yapay zeka özel programı: Oprah Winfrey, OpenAI’nin Sam Altman’ı, Microsoft’un Bill Gates’i, teknoloji etkileyicisi Marques Brownlee’yi ve mevcut FBI direktörü Christopher Wray’i konuk olarak içeren bir yapay zeka özel programını yayınladı.

Haftanın Araştırma Raporu

Biliyoruz ki yapay zeka ikna edici olabilir, ancak bir kişiyi yanlış bir komplo teorisinin içinden çıkarabilir mi? Kendisi başına değil, ancak MIT ve Cornell’den Costello ve arkadaşlarının yaptığı yeni bir model en azından birkaç ay boyunca anlamsız komplo teorilerine olan inançlarda bir azalma sağlayabiliyor.

Deneyde, komplo teorileriyle ilgili ifadeleri inanan insanları, argümanlarının karşısına çıkan sohbet botuyla konuşturdular. Bu konuşmalar, insanların inançlarında, en azından ölçülebilen bir şekilde, ilişkili inançlarda %20 azalma olduğunu ortaya koydu. İşte devam eden konuşmalardan bir örnek:

Kesin olarak, reptilianlar ve derin devlet komplolarına karışmış olanların böyle bir yapay zekayı danışacakları veya inanacakları pek olası değildir, ancak yaklaşım, bir kişinin bu teorilere ilk kez girdiği önemli bir aşamada kullanıldığında daha etkili olabilir. Örneğin, bir genç “Uçak yakıtı çelik kirişleri eritebilir mi?” diye arama yaptığında, trajik bir durum yerine bir öğrenme anı yaşayabilir.

Haftanın Modeli

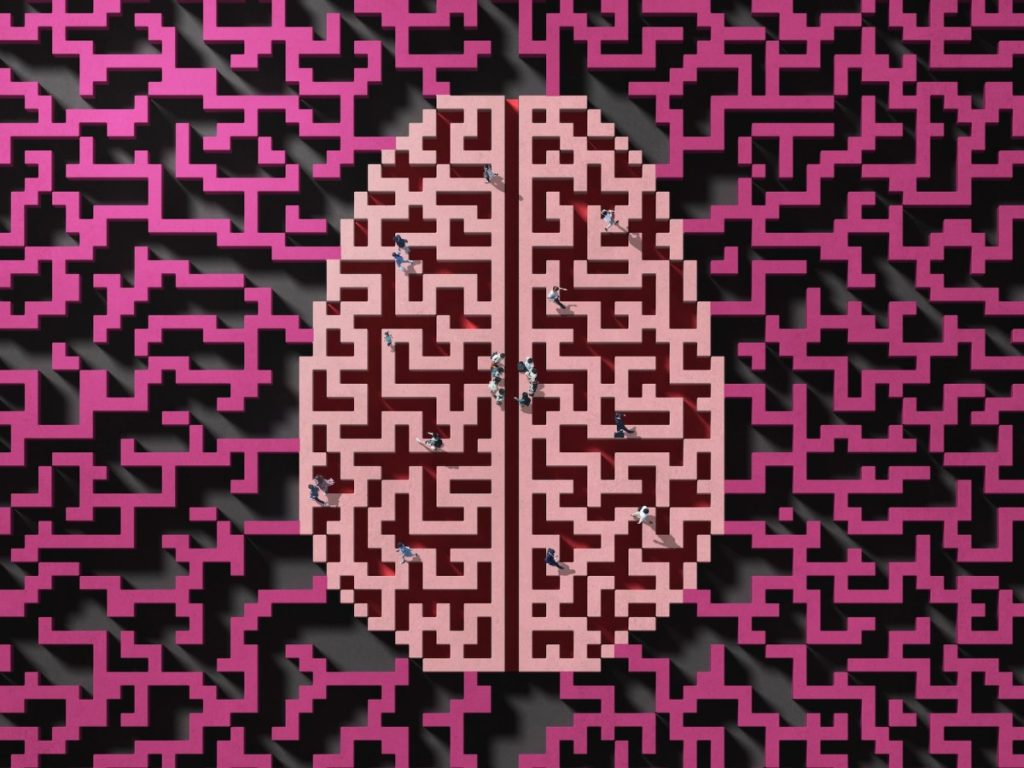

Bir model olmasa da modellerle ilgili: Microsoft araştırmacıları bu hafta “Eureka” adında bir yapay zeka testi yayınladı. Araştırmacılar, Eureka için, en yetenekli modellerin bile zorlu kalan görevleri seçtiklerini söylüyorlar. Özellikle Eureka, yapay zeka testlerinde genellikle gözden kaçan, görsel mekansal gezinme becerileri gibi yetenekleri test ediyor.

Yapılan testlerde, araştırmacılar Anthropic’in Claude, OpenAI’nin GPT-4o ve Meta’nın Llama gibi sistemleri Eureka testine tabi tuttular. Hiçbir model, Eureka’nın tüm testlerinde iyi bir sonuç alamadı ve araştırmacılar, modellere “devam eden yenilik” ve “hedeflenen geliştirmeler” yapmanın önemini vurguladı.

Diğer Haberler

Profesyonel oyuncular için bir zafer olarak, California, AI dijital replikaların kullanımını sınırlayan AB 2602 ve AB 1836 adlı iki yasayı kabul etti.

Bu yasalar, oyuncunun dijital replikasına dayanan şirketlerin replikanın amaçlanan kullanımına “makul derecede spesifik” bir açıklama yapmalarını ve oyuncunun yasal danışmanı veya işçi sendikası ile müzakere etmelerini gerektiriyor. Ayrıca, bir ölü oyuncunun dijital replikasını kullanmadan önce eğlence işverenlerinin, kişinin mirasından izin alması gerekiyor.

İlgili içerikler için lütfen https://wm.org.tr adresine bakınız.