AI alanındaki hızlı gelişmeler, büyük dil modelleri (LLM’ler) için yüksek kaliteli veri setlerinin hazırlanmasını önemli bir zorluk haline getirmiştir. Bu, bir modelin doğruluğunu, performansını ve farklı görevler ile alanlar boyunca güvenilir ve tarafsız sonuçlar üretme yeteneğini doğrudan etkilemektedir.

NVIDIA ile Dataloop arasındaki ortaklık sayesinde, bu engeli doğrudan hedef alıyoruz ve işletmelerin AI uygulamaları için veri hazırlama ve yönetme şeklini devrim niteliğinde değiştiriyoruz.

Dataloop, NVIDIA Inception üyesidir; bu program, çeşitli aşamalardaki girişimlerin gelişimini hızlandırmayı amaçlamaktadır.

AI İçin Veri Hazırlamada Devrim

NVIDIA NIM mikro hizmetlerinin Dataloop’un platformuyla entegrasyonu, LLM’ler için veri hazırlama iş akışlarını optimize etmede önemli bir atılım olmuştur. Bu iş birliği, işletmelerin büyük, yapısal olmayan veri setlerini etkili bir şekilde yönetmelerine olanak tanırken, AI destekli süreçler ve LLM eğitimleri için hazırlık işlemlerini basitleştirmektedir.

Ana Zorluklara Yaklaşım

Bugüne kadar, AI ekipleri LLM’ler için veri hazırlarken iki ana engelle karşılaştı:

- Multimodal Veri Setlerini Yönetme: Video, resim, ses ve metin gibi çeşitlilik gösteren veri türleri, her birinin kendine özgü işleme gereksinimleri olduğundan, bütünsel bir hazırlama süreci oluşturmayı zorlaştırmıştır.

- Veri Kalitesini Sağlama: Yapısal olmayan veri setleri, AI modellerinin içeriği doğru bir şekilde yorumlayabilmesi için gerekli tutarlılığı ve meta veriyi sıklıkla yitirmektedir. Bu durum, veri kalitesi sorunlarına yol açarak, uygun etiketleme ve organizasyon için manuel müdahaleyi gerektirir.

Dataloop, NVIDIA NIM’in gelişmiş çıkarım yeteneklerini kullanarak, yapısal olmayan veri setlerinin insan verisine yüksek kaliteli dönüşümünü sağlamakta ve AI uygulamaları için karmaşık davranışları yakalamaktadır.

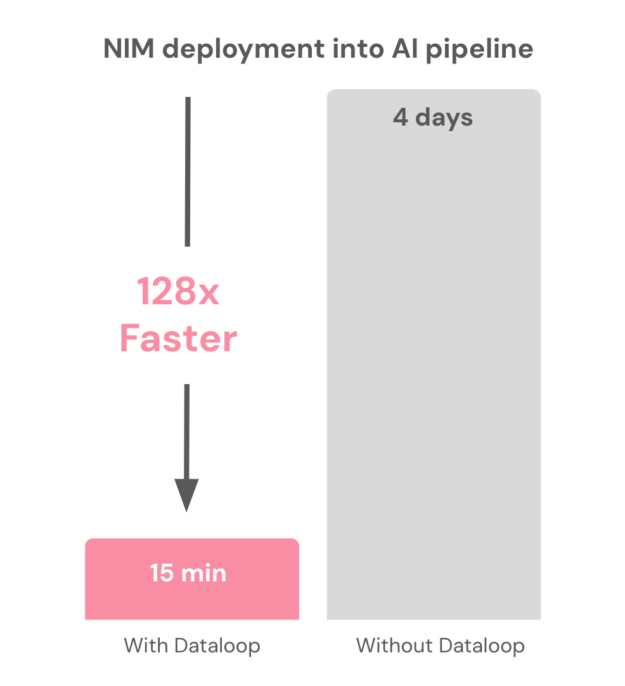

NIM mikro hizmetleri, GPU seviyesinde çıkarım sürecini hızlandırırken, Dataloop da NVIDIA modellerinin dağıtım sürecini otomatikleştirmeye odaklanmaktadır. Bu, geleneksel konteynerize yöntemlere kıyasla 128 kat daha hızlı bir dağıtım süresi yaratmaktadır.

Büyük indirmeler veya bulut yapılandırmalarıyla uğraşmanıza gerek yok; NIM modellerini yalnızca sürükleyip bırakabilir ve çalıştırabilirsiniz. Visual Studio Code’da real-time hata ayıklama ile, NIM mikro hizmetleri zahmetsiz bir şekilde üretime hazır hale gelmekte, manuel kurulum karmaşıklıklarını ortadan kaldırmakta ve verimli bir AI ölçeklenmesini desteklemektedir.

Dataloop Bunu Nasıl Gerçekleştiriyor?

Bu çözümün merkezinde, Dataloop’un platformuyla NVIDIA NIM çıkarım gücünü kusursuz bir şekilde birleştiren yapılandırılmış bir çerçeve bulunmaktadır. Bu entegrasyon, işletmelerin büyük, yapısal olmayan, multimodal veri setlerini daha önce görülmemiş bir kolaylıkla işleme almasını sağlamaktadır.

Dataloop, veri hazırlama ve yapılandırma gibi karmaşık görevleri otomatikleştirerek, derin altyapı uzmanlığı gereksinimini ortadan kaldırmakta ve organizasyonların AI modellerini zahmetsizce ölçeklendirmesine imkan tanımaktadır. Bu yapı, birden fazla LLM üzerinden veri akışlarını organize ederek, verilerin paralel olarak işlenmesini ve hızlı, doğru bir şekilde dağıtıma hazır hale gelmesini sağlamaktadır. Böylece, AI benimsemesi daha hızlı ve verimli bir hale gelmektedir.

NVIDIA NIM Nedir?

NVIDIA NIM mikro hizmetleri, herhangi bir bulut veya veri merkezinde üretken AI dağıtımını hızlandırmak için tasarlanmış sezgisel bir mikro hizmet setidir. NVIDIA AI temeli, topluluk ve özel modeller dahil olmak üzere çok sayıda AI modelini destekleyen NIM, yerel ya da bulutta kesintisiz, ölçeklenebilir AI çıkarımı sağlamaktadır.

NIM mikro hizmetleri, AI modellerinde daha sorunsuz bir şekilde çıkarım yapılmasına olanak tanıyan etkileşimli API’ler sunmaktadır. Modeller/model grubu bazında konteyner görüntüleri olarak paketlenmiştir (Şekil 2). NIM, çeşitli bulutlar, veri merkezleri ve iş istasyonları arasında önceden eğitilmiş ve özelleştirilmiş AI modelleri için GPU hızlandırmalı mikro hizmetleri kendiniz barındırmak üzere konteynerler sağlamaktadır.

NIM, düşük yanıt gecikmesi ve yüksek verim sağlayan NVIDIA TensorRT-LLM ve NVIDIA TensorRT kullanmaktadır. Çalışma zamanı sırasında, NIM mikro hizmetleri, her bir temel model, GPU ve sistem kombinasyonu için optimal çıkarım motorunu seçmektedir. NIM konteynerleri, standart gözlemlenebilirlik veri akışları ve NVIDIA GPU’larda Kubernetes ile otomatik ölçekleme desteği sunmaktadır. NIM özellikleri ve mimarisi hakkında daha fazla bilgi için NVIDIA NIM dökümantasyonuna göz atabilirsiniz.

Dataloop Nasıl Çalıştırıyor?

Girişimlerin zamanla topladığı büyük miktardaki çeşitli veri – video, resim, metin ve ses – LLM eğitimi için önemli bir iş değeri ve operasyonel fayda sağlayabilir. Ancak, bu değeri açığa çıkarmak için verilerin uygun bir şekilde hazırlanması ve zenginleştirilmesi gerekir; bu işlemler genellikle kaynak yoğun olmaktadır.

NVIDIA NIM’in Dataloop ile entegrasyonu sayesinde, işletmeler zenginleştirme sürecini hızlandırabilir ve verilerin AI uygulamaları için daha hızlı ve etkin bir şekilde hazırlanmasını sağlayabilir.

Dataloop, farklı veri kaynaklarına kolayca bağlanarak milyonlarca dosyayı hassas bir şekilde işler. NIM mikro hizmetleri ile birleştiğinde, Dataloop platformu AI iş akışlarını hızlandırarak geliştirme maliyetlerini azaltmakta ve derin teknik uzmanlık veya karmaşık bir altyapı gerektirmeden AI girişimlerinin ölçeklenmesine olanak tanımaktadır.

Phase 1: Veri Alma ve Senkronizasyon

İş akışı, AWS, Google Cloud, Azure gibi büyük bulut platformlarında depolanan büyük veri setlerinin zahmetsiz bir şekilde entegrasyonu ile başlar. Dataloop, veri akışını yöneterek her yeni dosyanın gerçek zamanlı olarak etiketlenmesini ve analiz edilmesini sağlamaktadır.

Bu dinamik senkronizasyon, veri setlerinin her zaman güncel, erişilebilir ve ön işleme ile AI model eğitimi için hazır olmasını garanti ederken, aynı zamanda hattın dinamik bir şekilde veri boyutu ve karmaşıklığı ile başa çıkacak şekilde ölçeklenmesini de sağlar.

Phase 2: Veri Yapılandırma ve Dönüşüm

Veri alma işlemi tamamlandıktan sonra, sonraki aşama verilerin LLM’ler için uygun hale getirilmesi için yapılandırılması ve dönüştürülmesidir. Bu aşamada NVIDIA, her bir dalda önemli bir rol oynamaktadır.

Yüksek verim ve düşük gecikme süresi sağlamak için NeVA gibi gelişmiş NIM modelleri kullanarak, hat, veri yapılandırma sürecini önemli ölçüde hızlandırmaktadır. Bu optimizasyonlar, işletmelerin daha fazla veriyi paralel olarak işlemesini sağlamakta ve multimodal veri setleriyle çalışan AI projeleri için pazara çıkış süresini azaltmaktadır.

Bu aşamada, Dataloop, içeriği sıralama, etiketleme ve özetleme gibi görevleri yönetmek için temel AI modellerini koordine etmekte ve verilerin verimli ve ölçeklenebilir bir şekilde hazırlanmasını sağlamaktadır.

NIM Entegrasyonunun Kolaylığı

NVIDIA çözümleri, NIM mikro hizmetleri dahil olmak üzere Dataloop platformundaki NVIDIA Marketplace Hub’da mevcuttur ve geliştiriciler için entegrasyonu basit ve hızlandırılmış hale getirmektedir. Bu önceden eğitilmiş, son teknoloji modeller anında kullanılabilir hale gelir ve yeni veya mevcut veri hatlarına hazır bir şekilde dağıtılır.

Sezgisel tak-çıkar işlevselliği ile, karmaşık kurulum adımlarını geçebilir ve AI projeleri için NIM mikro hizmetlerini hemen kullanmaya başlayabilirsiniz.

Yapılandırma İşlemleri Üzerine Derin Bir Dal

Dataloop’un NVIDIA NIM ile entegrasyonunun dönüştürücü gücünü tam anlamıyla kavrayabilmek için, platformun farklı veri türlerini nasıl yapılandırıp zenginleştirdiğine yakından bakmak önemlidir. Her iş akışı, farklı veri formatlarının benzersiz özellikleri ve zorluklarıyla başa çıkacak şekilde tasarlanmış olup, veri hazırlama sürecini verimli, akıcı ve doğru bir hale getirmektedir.

Dataloop’un veri zenginleştirme hattı, farklı veri formatlarının işlenmesini optimize etmek için şu şekilde işlemektedir:

- Görüntüler

- Videolar

- Ses

- Metin

Görüntü İş Akışı

Bir görüntü hattına ulaştığında, hemen NVIDIA NEVA-22B NIM mikro hizmeti ile işlenmektedir. Bu model, belirli proje için ilgili nesneleri, sahneleri veya öğeleri tespit ederek, görüntüleri olağanüstü bir hassasiyetle otomatik olarak etiketlemektedir.

Her dosya akışı boyunca, Dataloop otomatik olarak etiketleri dizinleyerek, platformun veri yönetim alanında kolayca erişilebilir ve daha fazla geliştirme yapılabilir hale getirmektedir.

Video İş Akışı

Video dosyaları, hareket değişikliklerini tespit ederek anahtar kareleri seçen Akıllı Kare Çıkarma düğümü aracılığıyla hattına girmektedir. Her kareyi işlemek yerine, Dataloop, yalnızca en özel kareleri belirlemek için sıfırdan video alt örnekleme tekniğini kullanmaktadır. Bu, işlem süresini ve kaynaklarını azaltmaktadır.

Seçilen bu anahtar kareler, NEVA-22B ile analiz edilmekte ve görüntülere uygulanan yüksek hassasiyetli etiketler şimdi video kareleri için kullanılmaktadır. Sonuçlar, zenginleştirilmiş veri seti için kullanılabilir hale gelmektedir. Etiketlendikten sonra işlenmiş kareler, orijinal video dosyasıyla senkronize bir şekilde dizinlenmektedir.

Ses İş Akışı

Ses dosyaları, Dil Tanımlayıcı düğümü aracılığıyla sınıflandırılmaktadır. Bu düğüm, dil tanımlama ve otomatik konuşma tanıma (ASR) için SpeechBrain kullanmaktadır.

Dil tespit edildikten sonra, düğüm OpenAI’nin Whisper’i transkripte bağlayarak konuşmaları metne dönüştürmektedir. Son olarak, Ses-Tanıma düğümü, transkriptleri bir LLM aracılığıyla geçirerek metni doğruluk ve tutarlılık açısından analiz etmektedir.

Bu süreç, transkriptlerin yalnızca doğru değil, aynı zamanda bağlamsal olarak anlamlı olmasını sağlamakta ve sesin ilettiği mesajı yakalamaktadır. Gelişmiş çıktı, Dataloop platformuna indekslenmekte ve ardından metin iş akışına aktarılmaktadır; böylece veri hemen AI işlemleri için erişilebilir hale gelmektedir.

Metin İş Akışı

Metin iş akışı, LlaMA 3.1 NIM mikro hizmeti ile başlamakta ve bu model, anahtar varlıkların çıkarımında özellik çağırma yeteneklerini kullanmaktadır. Böylece şirket adları, tarihler ve yerler gibi önemli varlıkların doğru bir şekilde belirlenmesi sağlanmaktadır.

Ardından, NVIDIA EmbedQA-Mistral-7bv2 modeli, metnin derin anlamını ve bağlamını yakalayan anlamsal gömme işlemleri gerçekleştirmektedir. Son olarak, Yükle-Sesi-Metin düğümü, işlenmiş metin verisinin düzgün bir şekilde indekslenmesini sağlayarak süreci tamamlamaktadır.

Zenginleştirilmiş Verilerin Yönetimi

Veriler yapılandırıldıktan sonra, zenginleştirilmiş veri setleri Dataloop’un veri yönetim bölümünde depolanmakta ve bu da verilerin yönetimini hem sezgisel hem de verimli hale getirmektedir.

Her tür dosya üzerinde hızlıca görselleştirme, inceleme ve gerçek zamanlı veri odaklı karar verme yapabilirsiniz. Dataloop, veri setlerinin sorgulanmasını, sürümlemesini ve oluşturulmasını basit bir şekilde sağlar, böylece her parçanın AI’ya hazır olmasını güvenle ölçeklendirebilirsiniz ve gecikme ya da zorluk yaşamadan kararlar alabilirsiniz.

Sonuç

NVIDIA NIM’in Dataloop platformuna entegrasyonu, işletmelere geliştirilen bir dizi avantaj sunmakta, bunlar arasında hızlı dağıtım, hızlandırılmış iterasyon imkanları, yüksek performanslı veri işleme ve sektördeki öncü modellerin sorunsuz entegrasyonu yer almaktadır.

Bu çözüm geliştikçe ve ölçeklendikçe, multimodal yeteneklerinin de sürekli olarak artırılması hedeflenmektedir. Mevcut sistem, video, ses, görüntü ve metin verilerini olağanüstü bir doğruluk ve verimlilikle işlerken, 3B, sensör, tablo ve konumsal veri gibi daha karmaşık veri türlerine genişleme fırsatlarını da heyecan verici buluyoruz.

Olası AI uygulamaları, otonom araçlar ve robotlardan çevresel izlemeye ve akıllı şehirlere kadar çeşitli alanlar’da, daha karmaşık veri setlerinin AI model eğitimine ve özel kullanım durumlarına hazırlanması için kapılar açacaktır.

NVIDIA mikro hizmetlerinin Dataloop üzerindeki teknik yönleri ve NVIDIA model dağıtımını hızlandırma ile AI iş akışlarınızı optimize etme hakkında daha fazla bilgi edinmek için Dataloop üzerindeki NIM mikro hizmetleri sayfasını inceleyebilirsiniz.

Stratejik ve veri odaklı bir bakış açısı için, AI İş Liderleri Ortaklığı sayfasına göz atabilirsiniz. Bu sayfada NVIDIA ve Dataloop’un işbirliğinin AI projelerini nasıl geliştirebileceğine dair vaka çalışmaları ve içgörüler bulabilirsiniz.