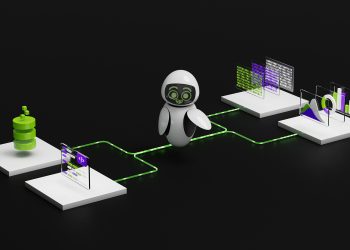

Yönetimsel iş akışları artık AI destekli araçların evriminin bir parçası olarak dönüşüyor. Bu sistemler, geliştiricilerin birden fazla AI modelini bir araya getirerek karmaşık faaliyetleri gerçekleştirmesine olanak tanıyor. Ayrıca, AI modellerinin ek verilere erişim sağlaması veya kullanıcı eylemlerini otomatikleştirmesi için araçlar kullanabilmesini sağlıyor. Bunun yanı sıra, AI modellerinin insan katılımı minimum seviyeye indirilerek otonom bir şekilde karmaşık görevleri analiz edip gerçekleştirilebilmesi mümkün hale geliyor.

Bununla birlikte, bu gücün bir takım riskleri de var. Otonom sistemlerin temel modelinin genellikle bir tür LLM (büyük dil modeli) olması, bu sistemlerin güvenilir olmayan verilerle enfekte olma olasılığını artırıyor. Bu durum, prompt injection şeklinde bilinen siber saldırılara maruz kalmalarına neden olabilir.

NVIDIA, bu zafiyetleri değerlendirip azaltmak amacıyla Agentic Autonomy adını verdiği bir çerçeve sunuyor. Bu çerçevenin amacı aşağıdaki gibi belirlenebilir:

- AI iş akışlarının artan karmaşıklığıyla ilgili riskleri anlamak

- Bu iş akışlarının oluşturduğu riskleri modellemek ve azaltmak

- Agentik sistemlere yönelik tehditleri nasıl modellediğimizi tanıtmak

Otonom Sistemlerin Manipülasyonu

AI destekli uygulamaların kötüye kullanımı, iki temel unsura dayanıyor:

- Bir saldırganın, verilerini (yani saldırı) sisteme bir mekanizma aracılığıyla sokması gerekir.

- Kötü niyetli verilerinin tetikleyebileceği bir sonraki adımda etkisi olmalıdır.

AI sisteminin bir LLM olması durumunda, bu genellikle doğrudan prompt injection (saldırgan ve kullanıcı aynı kişi) veya dolaylı prompt injection (saldırgan ve kullanıcı farklı kişiler olabilir) olarak adlandırılıyor.

Ancak, benzer tehditler, otonom AI destekli uygulamalarda kullanılan diğer AI modelleri için de mevcuttur. Bu iki tür prompt injection(birinin hedef almasıyla değer algısıyla değil, kullanıcı etkileşimleriyle ilişkili durumlar)LLM mimarisindeki kontrol ve veri düzlemi arasındaki ayrımın olmamasından kaynaklanıyor.

Güvenlik ve Otonomideki Karmaşıklık

“Otonom” AI sistemleri belirgin bir ürün sınıfı haline gelmeden önce, AI iş yüklerinin ardışık bir şekilde düzenlenmesi yaygındı. Örneğin, bir uç nokta güvenlik ürününün, bir dosya formatına bağlı olarak doğru AI destekli analiz motoruna bir örnek ile göndermesi gibi basit iş akışları bile bu türden bir akışı temsil edebilir.

Bu tür iş akışları determinist olduğundan, olası tüm yolları sırayla belirlemek, veri akışlarını haritalamak ve güvenilir olmayan verileri potansiyel olarak riskli eylemlerden ayırmak oldukça kolaydır.

Sektör, daha fazla iç karara sahip, daha yüksek derecede araç kullanabilen ve model bileşenleri arasında daha karmaşık etkileşimler olan sistemlere geçtikçe, potansiyel veri akış yollarının sayısı katlanarak artmakta ve bu da tehdit modellemesini zorlaştırmaktadır.

Tehdit Modelleme Süreci

Otonom sistemlerin artan bağımsızlık seviyeleri, mutlaka artan risk anlamına gelmez. Bunun yerine, sistem davranışının belirsizliği ve tahmin edilemezliği ile ilgilidir ve bu durum güvenilir olmayan verilerin etkisini değerlendirmeyi zorlaştırır. Otonom sistemlerdeki riskler genellikle sistemin erişebildiği araçlar veya eklentilerle ilgilidir. Bu da önemli eylemler gerçekleştirebilir:

- Bir satın alma işlemine tamamlama

- Bir e-posta gönderme

- Bir robotu hareket ettirme veya bir termostat ayarlama gibi fiziksel eylemler.

Özetlemek gerekirse, yukarıda bahsedilen sistemlerin karmaşıklığı > risk değerlendirmelerini zorlaştırır. Otonomite düzeyini belirlemek, sistemin karmaşıklığını değerlendirmek ve güvenlik kontrolleri ile gerekli önlemler için gereken çaba seviyesini belirlemek adına yararlı bir çerçeve sağlar.

Sonuç

Sistemler otonomi hiyerarşisinde yükseldikçe daha karmaşık ve tahmin edilmesi zor hale gelirler. Bu durum, çeşitli veri kaynakları veya araçların güvenilirliği ve hassasiyeti ile birlikte tehdit modeleme ve risk değerlendirmesini zorlaştırır.

Bu nedenle, eklentilerin dikkatlice analiz edilmesi ve uygun risk değerlendirmesinin yapılması gereklidir. Agentic süreçlerin sınıflandırılması ve doğru otonomi düzeyine yerleştirilmesi, sistemdeki potansiyel tehlikelerin belirlenmesini kolaylaştırır.