Gelişmiş alanlar, özellikle pil inovasyonu gibi karmaşık bilimsel araştırmalarda, malzemelerin manuel değerlendirmesi sürecinin yavaşlaması nedeniyle ilerleme kaydedememektedir. Bu yazıda, alan odaklı büyük dil modellerinin (LLM) gelişmiş mantık yetenekleriyle nasıl bilimsel araştırmaları dönüştürdüğünü inceliyoruz. Özellikle, bu yaklaşımın gerçek dünyadaki uygulaması olan SES AI’nin Molecular Universe LLM modelini örnek alarak pil inovasyonundaki etkilerini ele alıyoruz.

NVIDIA NeMo Framework, DGX Cloud ve NIM kullanarak oluşturulan eğitim ve çıkarım akışını öğrenebilirsiniz. Ayrıca, alan uyumlu pretraining, talimat eğitimi ve mantık uyumlaştırma gibi tekniklerin bilimsel keşifleri hızlandırmadaki rolünü keşfedeceksiniz.

Giriş

Büyük dil modelleri, bilimsel araştırmaları ilerletme potansiyelini büyük ölçüde geliştirdi. Bu modeller, akademik makaleleri özetleme, karmaşık bilgileri sentezleme ve yenilikçi hipotezler oluşturma gibi birçok görevi yerine getirebiliyor. Ancak, genel amaçlı LLM’ler, sıkça kullanılamayan özel terimlere ve bağlam bilgiye yeterince maruz kalmadığı için, alan spesifik görevlerde başarısız olabiliyor.

Bu boşluğu kapatmak için alan uyumlu LLM’ler, daha sürdürülebilir bir çözüm sunuyor. Yeni bir model eğitmek için gereken yüksek maliyet ve hesaplama yükü olmaksızın, Alan Uyumlu Ön Eğitim (DAPT) mevcut temel modellerin (örneğin LLaMA) işlevselliğini genişletiyor ve özelleştirilmiş, alan ile uyumlu metin koleksiyonlarıyla destekliyor.

Bu yaklaşım, özel alanlarda performansı önemli ölçüde artırırken, orijinal modelin geniş dil yeteneklerini koruyor. Ek olarak, modelin genel ve görev spesifik sorgulara yanıt verme becerisini artırmak için ince ayar yapılıyor. DAPT ve talimat eğitimi görev performansını artırırken, bu modelleri mantıklı düşünme yetenekleri ile donatmıyor.

Bunu aşmak için mantık uyumu tanıtılıyor. Bu, modellerin hipotez oluşturma, düşünme zincirini takip etme ve öz düzeltme gibi süreçleri mantıklı bir şekilde yönlendirmesine olanak tanıyor. Bu yetenekler, çok aşamalı sorunları çözmek ve malzeme araştırmasını ilerletmek için kritik öneme sahip.

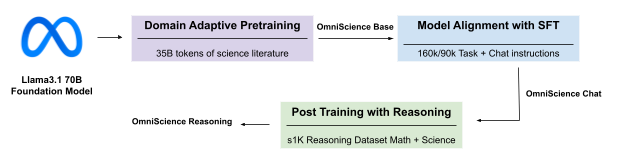

SES AI, pil inovasyonuna odaklanan bir firma, 70 milyar parametreye sahip özel bir model olan Molecular Universe LLM’yi geliştirdi. Llama 3.1 70B üzerine inşa edilen bu model, alan spesifik bilimsel görevlerde yeni bir standart belirliyor ve aynı kategorideki diğer modelleri geride bırakıyor.

Model, bir temel modeli yüksek performanslı, alan uyumlu bir modele dönüştüren veri çokluğu eğitimi ve uyumlu bir stratejiyle öne çıkıyor. Bu durum, DAPT, talimat eğitimi ve mantık tabanlı ince ayarın birleşiminin özel alanlarda verimlilik sağladığını vurguluyor.

Molecular Universe LLM, elektrik kimyasındaki potansiyel elektrikli sıvı ve katkı maddelerini sıralamak için gelişmiş mantık yeteneklerini kullanan bir yapay zeka destekli araştırma modelidir. Önceden, bilim insanları elektrikli sıvıların ve katkı maddelerinin sıralamasını sadece birkaç düzine adayla sınırlı olan uzmanlık bilgilerine dayanarak değerlendirmekteydi.

Uzun bağlam anlama, yapılandırılmış mantık yürütme ve uzman düzeyinde karar verme becerilerini birleştiren bu yaklaşım, alan uyumlu mantık modellerinin bilimsel yenilik alanındaki atılımları nasıl hızlandırdığını ve pil uzmanlarının verimliliğini nasıl artırdığını göstermektedir.

Molecular Universe LLM, NVIDIA DGX Cloud kullanarak NVIDIA NeMo Framework üzerinde üç aşamalı bir süreç ile eğitildi:

- Birinci Aşama: Özel bilimsel literatür üzerinde sürekli ön eğitim, NVIDIA NeMo Curator kullanılarak gerçekleştirildi.

- İkinci Aşama: Yerleşik veriler kullanarak denetimli ince ayar (SFT) yapıldı.

- Üçüncü Aşama: Karmaşık bilimsel mantık yetenekleri için modeli uyumlaştırmak için filtrelenmiş s1K mantık verileri üzerinde sonrası eğitim yapıldı.

Bu yaklaşım, modelin alan spesifik, bağlama uygun ve yüksek kaliteli yanıtlar üretmesini sağlıyor. Molecular Universe LLM’nin, NVIDIA ALCHEMI GPU hızlandırmalı simülasyon verileri ve NVIDIA cuML üzerinde üretilen moleküler haritalarla entegrasyonu, pil araştırmalarındaki on yılları aylara indiriyor.

Modelin Eğitimi için Altyapı Oluşturma

Molecular Universe LLM, 128 NVIDIA H100 GPU üzerinde NVIDIA DGX Cloud’da eğitildi. Bu platform, önemli bulut sağlayıcıları ile işbirliği içinde tasarlanmış bir AI eğitim platformudur. DGX Cloud, iş yükü optimizasyonu, görev zamanlama ve orkestrasyon için NVIDIA yönetimli Kubernetes ve NVIDIA Run:ai içerir. Geliştiriciler, dağıtım gerekliliği olmaksızın, özel bir kümede dağıtık eğitim koşullarına hemen başlayabilir.

NVIDIA NeMo Framework, NVIDIA DGX Cloud üzerinde AI geliştirme platformu olarak kullanıldı. Bu, ölçekli bir şekilde jeneratif AI modelleri oluşturmak, özelleştirmek ve dağıtmak için kesintisiz bir deneyim sunar. Ayrıca, binlerce GPU üzerinde yüksek eğitim verimliliği ve ölçeklenebilirlik sağlarken, en son modeller ve algoritmaları destekler.

NVIDIA Run:ai, yöneticilerin GPU kapasitesini “Projeler” ve “Departmanlar” aracılığıyla düzenlemesine olanak tanır. Bu da ekiplerin eğitim iş yükleri için gereken kapasiteyi almasını sağlar. Planlayıcı, aşırı yüklemeye olanak tanır, bu da fazla kaynak kullanıldığında iş yüklerinin ek kapasiteden faydalanmasına imkan tanır. Bu durum, GPU kullanımını artırırken, kaynak tahsislerine saygı göstermenizi sağlar, geliştirici verimliliğini artırır ve değer elde etme süresini kısaltır.

Birinci Aşama: Sürekli Ön Eğitim

Bir alan uzmanı olabilmesi için, Llama 3.1 70B modeli pil araştırmalarına özgü geniş bir metin koleksiyonu üzerinde sürekli ön eğitim aldı. Bu süreç, modelin bağlama uygun, doğru yanıtlar verebilmesi için gerekli derin bilgilere sahip olmasına yardımcı oldu.

Veri Kürasyonu ve İşleme

Ön eğitim veri kümesi, hakemli dergilerden ve preprint kaynaklarından alınan 19 milyon açık kaynaklı makaleden oluşuyordu. Bu makalelerin içeriği sade metne dönüştürüldü. Ön eğitim öncesinde belgeler, NVIDIA NeMo Curator kullanılarak işlenerek düşük kaliteli verilerin süzülmesi ve tekrar eden kısımların giderilmesi sağlandı.

| Veri Kaynakları | Belgeler |

| Açık Kaynak Hakemli Edebiyat | ~4M |

| arXiv | 1.4M |

| ChemRxiv | 26K |

| Açık Araştırma | 12M |

| PubChem | 60K |

| Akademik Ders Kitapları | 80 |

| PLOS | 200K |

Model Mimarisinin ve Eğitim Detaylarının Tanıtımı

Molecular Universe LLM Temel modeli, LLaMA 3.1 70B modelinin önceden eğitilmiş ağırlıkları ile oluşturuldu. Devam eden ön eğitim sürecinde NeMo Framework, en son optimizasyon teknikleri kullanıldı. Bu teknikler arasında 4D paralel işleme, karışık hassasiyet eğitim ve flaş dikkat algoritmaları yer alıyor. Ayrıca uzun dizilerle başa çıkabilmesi için NeMo bağlam paralelliği kullanıldı.

Model 8.192 token (kelime birimi) uzunluğunda giriş dizileriyle eğitildi ve her ileri geçişte 524.288 token işlenebildi. Eğitim süreci toplamda 144 saat sürdü ve işlem sırasında bfloat16 hassasiyeti korundu. Alan uyumlu ön eğitim, orijinal ön eğitimde kullanılan toplam token miktarının yalnızca %1,5’ini gerektirdi.

Eğitim ve doğrulama kayıp profilleri, başlangıç adımlarında hızlı bir düşüş gösterdi ve zamanla dengelendi, bu da etkili bir yakınsama sağlandığını gösteriyor.

İkinci Aşama: Denetimli İnce Ayar ile Modelin Uyumlaştırılması

Molecular Universe Temel modelinin alan bilgileri ile uyumlu hale getirilmesi ve talimatları takip etme yeteneğinin artırılması için denetimli ince ayar (SFT) uygulandı. Denetimli ince ayar, modelin etiklenmiş örnekler üzerinde eğitilmesiyle, alan odaklı yanıt üretme yeteneğini geliştirir.

Veri Kürasyonu ve İşleme

SES, NVIDIA Llama 3.1 70B NIM verilerini kullanarak yüksek kaliteli bir SFT veri kümesi oluşturmak için 50.000 makaleyi örnekleyip 200.000 talimat örneği üretti. Bu örneklerden 160.000’i eğitim için, 40.000’i ise değerlendirme için kullanıldı.

Son olarak, Daring-Anteater veri seti‘nden 90.000 genel sohbet örneği ekleyerek, toplam SFT veri seti 250.000 örneğe ulaştı. Bu noktada, NIM’in alan odaklı eğitim verisi oluşturma konusundaki etkinliği öne çıkıyor.

Model Mimarisinin ve Eğitim Detaylarının Tanıtımı

Oluşturulan bu veri kümesi, LLaMA 3.1 70B sözlük kullanılarak tokenize edildi ve daha sonra NeMo Framework ile çok düğümlü bir sistemde SFT ile ince ayar yapıldı. Sonuç itibarıyla, Molecular Universe Chat modeli elde edildi. Model, 128 NVIDIA H100 GPU üzerinde eğitim aldı ve NVIDIA Run:ai yazılımı ile yalnızca 32 saat içerisinde tamamlandı.

Eğitim ve doğrulama kayıp profilleri, hızlı bir düşüş gösterdi ve yaklaşık 400 adımda dengelendi. Ancak, 600 adım sonrasında eğitim kaybındaki hafif bir artış, aşırı öğrenme veya öğrenme oranına duyarlılık gibi durumlara işaret edebilir. Buna karşın, doğrulama kaybı istikrarlı kaldı, bu da güçlü bir genelleme performansını gösteriyor.

Üçüncü Aşama: Yüksek Kaliteli Mantık Verisi ile Sonrası Eğitim

Alan uyumlu ön eğitim ve talimata dayalı ince ayar, modelin genel ve alan odaklı soruları cevaplama becerisini artırırken, karmaşık bilimsel sorunları çözmek için gereken çok aşamalı mantık yürütme yeteneklerini en iyi şekilde geliştiremiyor.

Bunu aşmak adına, Molecular Universe Chat modeli, yüksek kaliteli ve zorlayıcı soruları içeren s1K Mantık Verisi’nden yaklaşık 25.000 örnek üzerinde ince ayar yapıldı. S1K veri kümesi, alt seviyedeki modellerin kolayca yanıtlayabileceği soruları ve düşük kalitedeki örnekleri filterlemek amacıyla filtrelendi.

Ayrıca, bir LLM, örnekleri tematik kategorilere (örn. matematik, bilim) ayırmak için kullanıldı ve uzun mantık izleri içeren örneklere bir önyargı uygulamak amacıyla uniform örnekleme yapıldı. Sonuçta elde edilen veri örnekleri, belirli görevlerle ilgili kıyaslamaları yok etmek için daha da tamir edildi.

Sonrası eğitim, mantık izlerinin korunabilmesi adına bağlam uzunluğunun 16.000’e çıkarıldığı NeMo Framework kullanılarak gerçekleştirildi. Bu süreç, 64 H100 GPU üzerinde 12 saat sürdü ve 5 eğitim dönemi tamamlandı. Bu adım, hem doğruluk hem de daha karmaşık düşünmeyi tartışma yeteneğini artırdı, GPQA Diamond testinden 0.72 puan aldı.

Sonuçlar

Molecular Universe Chat ve Reasoning modeli, bilim odaklı kamuya açık standartlar üzerinde değerlendirildi; GPQA Diamond ve özel alan odaklı standartlar gibi. Bu model, GPQA Diamond üzerinde 0.72 puana ulaşarak birçok diğer benzer boyut ve daha büyük açık kaynaklı modelleri geride bıraktı.

Molecular Universe Reasoning modeli, MMLU, Winogrande, Hellaswag ve ARC-E gibi kamu standartlarında Llama 3.1 70B’yi geride bıraktı. Temel modelin performansındaki bu önemli artış, sürekli alan uyumlu ön eğitim ve mantık odaklı sonrası eğitimin modelin yeteneklerini geliştirmedeki önemini vurguluyor.

| Model | Parametre Sayısı | Pil Soru/Cevap | Pil Çoktan Seçmeli | Pil Okuma Anlayışı | Pil Özeti | Pil Mantık |

| GPT-o1 | – | 96% | 92% | 90% | 88% | 84% |

| Molecular Universe Reasoning | 70B | 96% | 89% | 90% | 86% | 82% |

| Claude 3.7 Sonnet | – | 94% | 86% | 89% | 86% | 80% |

| Gemini Flash Thinking | – | 92% | 85% | 88% | 82% | 79% |

| Molecular Universe Chat | 70B | 93% | 79% | 84% | 79% | 73% |

| LLaMA 3.1 | 70B | 71% | 67% | 78% | 75% | 66% |

Molecular Universe Chat ve Reasoning modelleri, 40.000 SFT tutulmuş test seti ve özel bir pil odaklı akıl yürütme ölçütü üzerinde değerlendirildi. Model, GPT-o1, LLaMA 3.1 70B, Claude 3.7 Sonnet 50B ve Gemini 60B gibi modellerle kıyasladı.

Soru/Cevap, Çoktan Seçmeli, okuma anlayışı, özetleme ve mantık gibi görevlerde, Molecular Universe Reasoning LLM, yalnızca GPT-o1 hariç her tümüyle kıyaslandığı diğer modelleri geride bıraktı. GPT-o1’in bir avantajı bulunmasına rağmen, daha az parametre ve düşük eğitim maliyeti ile birlikte Molecular Universe Reasoning sonuçlar verdi, bu da alan uyumu ve mantık önceliğinin etkisini vurguluyor.

Sonuç ve Gelecek Çalışmalar

Molecular Universe Reasoning, 70B parametreye sahip bilimsel akıl yürütme LLM’si, boyut sınıfındaki bilimsel görevlerde en iyi performansı sergiliyor. Alan uyumlu ön eğitimi ve mantık tabanlı denetimli ince ayarı birleştiren verimli bir eğitim stratejisi, temel modelin performansını önemli ölçüde artırarak bunun yanı sıra ek işlem maliyeti gerektirmiyor.

Her iki teknik de birbirini tamamlayarak, yalnızca bir yöntemle elde edilen sonuçlardan daha iyi performans sunmaya yardımcı oldu. Molecular Universe Reasoning modeli, NIM mikro hizmet desteği ile dağıtıldı ve modelin gerçek zamanlı sunumu için ölçeklenebilir bir yapı sağlıyor. Molecular Universe LLM, SES AI’nin Molecular Universe (MU-0) isimli malzeme keşif platformuna entegre edilecek. Bu platform, pil araştırmacılarına ve sanayi profesyonellerine, tek bir arayüz üzerinden aday küçük moleküllerin geniş bir veritabanını keşfetme imkanı sunan bir yazılım ve hizmet çözümüdür.

Gelecek çalışmalar, modelin alan odaklı akıl yürütme sonrası eğitimini daha da geliştirecek, özellikle de görevle ilgili akıl yürütmeyi artıracak özel bir pillere odaklı veri seti oluşturacak ve insan geribildirimi ile pekiştirilmiş öğrenmeyi keşfedecektir. Bu çalışma, farklı alanlarda güçlü uzmanlık yeteneklerine sahip, maliyet etkin, orta boyutlu (

NeMo Framework’ü NVIDIA DGX Cloud üzerinde daha fazla öğrenmek için resmi NVIDIA belgelerine ve GitHub sayfasına göz atın. Bugün NVIDIA DGX Cloud ile başlayın. NVIDIA ALCHEMI’yi keşfedin ve ileri düzey makine öğrenimi çözümleri için NVIDIA cuML’i inceleyin.

Bu yazıda, Zihan Wang (NVIDIA) ve Kang Xu (SES) değerli destek ve görüşleri için teşekkür ederiz.