Yıllardır yapay zekadaki ilerlemeler, ön eğitim ölçeklendirme ile belirgin bir yol izledi: daha büyük modeller, daha fazla veri ve artan hesaplama kaynakları, çarpıcı yetenekler kazandırdı. Son 5 yılda, ön eğitim ölçeklendirmesi, hesaplama gereksinimlerini 50 milyon kat artan bir hızla artırdı. Ancak, daha zeki sistemler inşa etmek artık sadece daha büyük modellerin eğitilmesiyle ilgili değil; bunun yerine, onları rafine etmek ve düşünmeye yönlendirmek üzerine odaklanmak gerekiyor.

Yapay zeka modellerinin belirli görevler için optimize edilmesi, modelin daha akıcı yanıtlar vermesini sağlayan sonrası eğitim ölçeklendirme ile mümkündür. Alanına özgü ve sentetik verilerle ayarlanan modeller, ince bağlamları anlamada ve doğru çıktılar sağlamada daha yetkin hale geliyor. Sentetik veri üretimi, bir modeli öğretmek için kullanılabilecek içerikte bir üst limit olmadığı için, sonrası eğitim ölçeklendirme için önemli hesaplama kaynakları gereksinimi doğuruyor.

Şimdi, yeni bir ölçeklendirme yasası zeka kapasitesini artırmak üzere ortaya çıktı: test anı ölçeklendirmesi.

Ayrıca uzun düşünme olarak bilinen test anı ölçeklendirmesi, yapay zeka çıkarımında hesaplamayı dinamik olarak artırarak daha derin bir akıl yürütme sağlar. Yapay zeka akıl yürütme modelleri sadece yanıt üretmekle kalmaz; aynı zamanda aktif bir şekilde düşünür, çeşitli olasılıkları tartar ve cevapları gerçek zamanlı olarak geliştirir. Bu, bizi gerçek temsilci zekaya daha yakın hale getiriyor – kendi başına düşünebilen ve hareket edebilen yapay zeka, daha karmaşık görevlerle çalışarak daha faydalı yanıtlar sağlayabilir.

Post-Eğitim ve Test Anı Ölçeklendirme

Bu post-eğitim ve test anı ölçeklendirme kayması, katlanarak artan hesaplama, gerçek zamanlı işlem ve yüksek hızlı bağlantılar talep ediyor. Özelleştirilmiş türev modellerin geliştirilmesi için sonrası eğitim, ön eğitimden 30 kat daha fazla hesaplama gerektirebilirken, uzun düşünme, karmaşık görevleri çözmek için bir tek çıkış geçişine göre 100 kat daha fazla hesaplama gerektirebilir.

Buna yanıt olarak, NVIDIA, yapay zeka akıl yürütmesi çağında tasarlanmış Blackwell Ultra adlı bir hızlandırılmış hesaplama platformu tanıttı. Blackwell Ultra, eğitim, sonrası eğitim ve test anı ölçeklendirmesi için tasarlanmıştır. Bu platform, akıllı, hızlı ve verimli yapay zeka sağlar ve toplam maliyet optimizasyonunu (TCO) üst düzeye çıkartmaya yöneliktir.

Blackwell Ultra ve NVIDIA GB300 NVL72 Sistemleri

Blackwell Ultra, NVIDIA GB300 NVL72 sistemlerinin merkezinde yer alıyor. Bu sistem, tek bir 72-GPU NVLink alanında 36 NVIDIA Grace CPU ve 72 Blackwell Ultra GPU’yu birbirine bağlayan sıvı soğutmalı bir raf ölçeği çözümüdür. Toplam NVLink bant genişliği 130 TB/s olarak çalışır.

| GB300 NVL72 | GB200 NVL72 | HGX H100 | |

| FP4 Çıkarma1 | 1.4 | 1.1 ExaFLOPS | 1.5x | 70x |

| HBM Bellek | 20 TB | 1.5x | 30x |

| Hızlı Bellek | 40 TB | 1.3x | 65x |

| Ağ Bant Genişliği | 14.4 TB/s | 2x | 20x |

1Sparsity ile | Sparsity olmadan

Blackwell Ultra, gerçek zamanlı çoklu ajans yapay zeka sistem boru hatları ve uzun bağlam akıl yürütmesi için daha fazla yapay zeka çıkarım performansı sunuyor. Yeni Blackwell Ultra Tensor Cores, Blackwell GPU’lara kıyasla %50 daha fazla AI hesaplama FLOPS ve GB300 NVL72’nin HGX H100’e göre 70 kat daha fazla AI FLOPS sunuyor. Ayrıca, Blackwell Ultra, son teknoloji AI için bellek kullanımını optimize eden birden fazla FP4 topluluk formatını destekliyor.

Her GPU başına 288 GB HBM3e belleğe kadar ve her GB300 NVL72 rafında 40 TB’a kadar yüksek hızlı GPU ve CPU uyumlu belleğe sahip olan Blackwell Ultra, AI, araştırma, gerçek zamanlı analiz ve daha fazlasında devrim niteliğinde ilerlemelere kapı açıyor. Aynı anda birçok büyük modelin hizmet vermesi ve çok sayıda karmaşık görevi birçok kullanıcıdan alarak performansı artırması ve gecikmeyi azaltması için gereken büyük ölçekli belleği sağlıyor.

Verimliliği Artıran Büyük Ölçekli Dağıtık Çıkarma

Geniş ölçekli GPU dağıtımları arasında yapay zeka çıkarım taleplerinin verimli bir şekilde düzenlenmesi ve koordine edilmesi, operasyonel maliyetleri minimize etmek ve AI fabrikalarındaki token bazlı gelirleri maksimize etmek için hayati önem taşır.

Blackwell Ultra, NVIDIA ConnectX-8 800G SuperNIC ile PCIe Gen6 bağlantı noktaları ile birlikte gelerek ağ bant genişliğini 800 Gb/s’ye çıkarır. Daha fazla ağ bant genişliği, daha fazla performans anlamına gelir. NVIDIA Dynamo’dan yararlanın; bu, yapay zeka modellerini çoklu node ortamlarında sunmak için bir modüler çıkarım çerçevesidir. Dynamo, çıkarım yüklerini GPU node’ları arasında ölçeklendirir ve trafik darboğazlarını azaltmak için GPU işçilerini dinamik olarak tahsis eder.

Dynamo ayrıca, büyük dil modeli (LLM) çıkarması için geniş bir bellek alanını optimize etmek amacıyla bağlam (önceden ayar) ve üretim (çözümleme) aşamalarını ayırarak hizmet vermektedir. Her sistemde GPU başına toplam 800 Gb/s veri iletimi mevcut bayi, GB300 NVL72’nin NVIDIA Quantum-X800 ve NVIDIA Spectrum-X ağ platformları ile mükemmel bir şekilde entegre olur; AI fabrikaları ve bulut veri merkezleri, üç ölçekleme yasasının gereksinimlerini karşılayabilir.

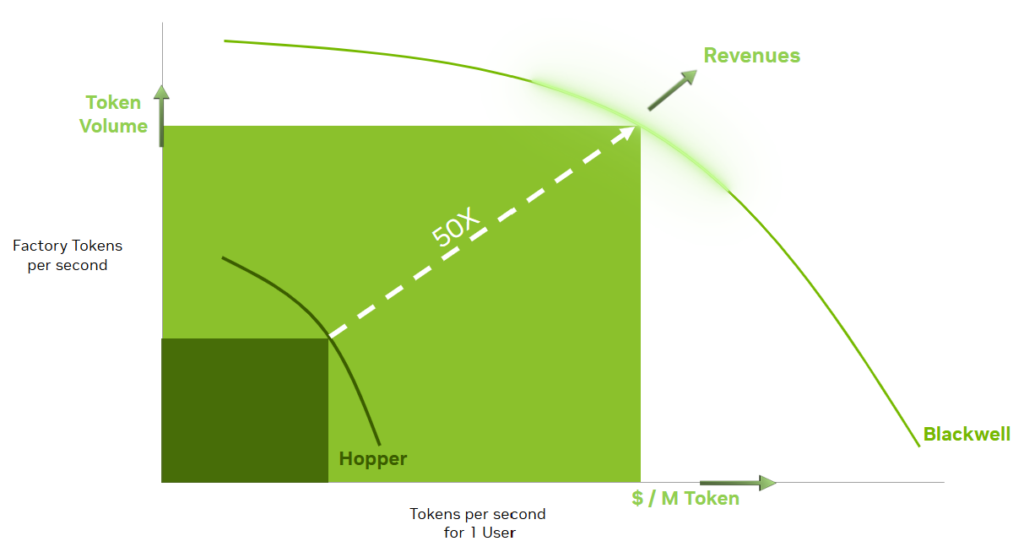

AI Fabrikası Çıktısında 50 Kat Artış

Şekil 1, AI fabrikası çıktısını maksimize etmek için çeşitli çalışma noktalarını belirleyen iki temel parametreyi göstermektedir. Dikey eksen, 1 Megawatt (MW) veri merkezinde saniyede geçirilen çıkışı belirtirken, yatay eksen, bireysel bir kullanıcı için saniyede geçirilen token miktarını gösterir.

NVIDIA GB300 NVL72 ile AI fabrikaları, kullanıcı başına TPS’de %10 artış ve aynı anda MW başına TPS’de %5 iyileşme sağlayacaktır. Bu birleşik etki, toplamda AI fabrikası çıktı performansında %50 potansiyel artış sağlar.

Sonuç

Blackwell Ultra ile hızlı yapay zeka akıl yürütmesi, gerçek zamanlı içgörüler, daha akıllı ve duyarlı sohbet botları, geliştirilmiş tahmine dayalı analizler ve daha üretken yapay zeka temsilcileri gibi birçok sektörde, finans, sağlık hizmetleri ve e-ticaret gibi alanlarda daha iyi hizmet sunmayı mümkün kılmaktadır. Bu devrim niteliğindeki platform, kuruluşların daha büyük modelleri ve yapay zeka akıl yürütme yüklerini hızlı bir şekilde idare etmesine olanak tanıyarak, gelişmiş yapay zeka yeteneklerini gerçek dünya uygulamaları için daha erişilebilir ve pratik hale getirmektedir.

NVIDIA Blackwell Ultra ürünlerinin, 2025’in ikinci yarısında ortaklar aracılığıyla piyasada olması bekleniyor ve tüm büyük bulut hizmeti sağlayıcıları ile sunucu üreticileri tarafından desteklenecektir. Daha fazla bilgi için şu kaynaklara göz atın: