Günlük ve haftalık bültenlerimize katılarak sektör lideri AI haberlerinin en son güncellemeleri ve özel içerikler aldığınızdan emin olun. Daha fazla bilgi edinin.

Hugging Face, yapay zeka alanında devrim niteliğinde bir başarıya imza atarak, telefon gibi küçük cihazlarda çalışabilen görsel-dil modelleri geliştirdi. Bu yeni modeller, daha önce büyük veri merkezlerine ihtiyaç duyan sistemleri geride bıraktı.

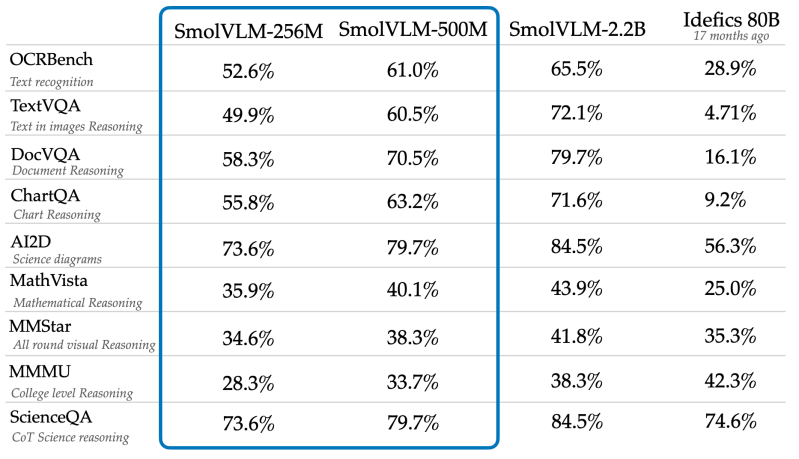

Şirketin yeni SmolVLM-256M modeli, bir gigabayttan daha az GPU belleği gerektirmekte ve sadece 17 ay önce tanıtılan Idefics 80B modeli‘ni geride bırakmaktadır. Bu durum, model boyutunda 300 katlık bir azalma ile birlikte önemli bir performans artışını beraberinde getiriyor. Bu gelişme, pratik AI uygulamaları için bir dönüm noktası niteliği taşımaktadır.

Hugging Face’ten Andrés Marafioti, yaptığı açıklamada, “Ağustos 2023’te Idefics 80B’yi piyasaya sürdüğümüzde, açık kaynaklı ilk sistem olduk. SmolVLM ile 300 kat daha küçük bir boyutla performans artışı sağlamak, görsel-dil modellerinde bir devrim niteliğindedir.” dedi.

Günlük Cihazlarda Çalışan Daha Küçük AI Modelleri

Bu gelişme, işletmelerin yüksek yapay zeka maliyetleriyle mücadele ettiği kritik bir dönemde geliyor. Yeni SmolVLM modelleri — 256M ve 500M parametre boyutlarında — görsel içeriği daha önce ulaşılamayan hızlarla işleyip anlayabiliyor.

En küçük versiyon günde 16 örneği işleyerek sadece 15GB RAM kullanmakta ve bu, büyük miktarda görsel veri işleyen şirketler için oldukça cazip bir seçenek sunmaktadır. Marafioti, “Aylık 1 milyon görüntü işleyen orta ölçekli bir şirket için bu, yılda büyük tasarruflar sağlayabilir.” dedi.

Küçük Modeller, Büyük İşletmeler için Verimlilik Sunuyor

Geliştirme, büyük teknoloji firmalarının dikkatini çekti. IBM, Hugging Face ile birlikte 256M modelini Docling adlı belgeleri işleme yazılımına entegre etmek amacıyla bir ortaklık kurdu. Marafioti, “IBM önemli hesaplama kaynaklarına sahip olsa da, bu küçük modelleri kullanmak, maliyetlerin düşürülmesi açısından verimli bir şekilde milyonlarca belgeyi işleyebilmelerini sağlıyor.” şeklinde belirtti.

Güçten Ödün Vermeden Boyut Nasıl Azaltıldı?

Bu verimlilik kazanımları, hem görsel işleme hem de dil bileşenlerinde yapılan teknik yeniliklerden kaynaklanmaktadır. Ekip, 400M parametreli bir görsel kodlayıcıdan, 93M parametreli olan bir versiyona geçiş yaptı ve daha etkili token sıkıştırma teknikleri uyguladı. Bu değişiklikler, yüksek performansı sürdürürken hesaplama gereksinimlerini dramatik şekilde azaltmayı sağladı.

Küçük işletmeler ve girişimler için bu gelişmeler dönüşüm yaratabilir. Marafioti, “Girişimler artık karmaşık bilgisayarlı görsel ürünlerini haftalar içinde başlatabiliyor, daha önce yüksek olan altyapı maliyetlerini düşürdü.” dedi.

Daha Küçük AI Modellerinin Geleceği

Bu gelişme, model boyutu ve yetenekleri arasındaki geleneksel anlayışı sorgulatıyor. Birçok araştırmacı, gelişmiş görsel-dil görevleri için daha büyük modellerin gerekli olduğunu varsayıyordu. Ancak, SmolVLM, daha küçük ve daha verimli mimarilerin benzer sonuçlar alabileceğini gösteriyor. 500M parametre versiyonu, önemli kıstaslarda 2.2B parametreli kardeşinin performansının %90’ını sağlıyor.

Marafioti, bu sonuçların verimlilik düzeyinin değil, keşfedilmemiş potansiyelin bir kanıtı olduğunu görmekte. “Bugüne kadar standart, 2B parametreli VLM’ler piyasaya sürmekti; daha küçük modellerin yararlı olmadığını düşünüyorduk. Şimdi, aslında 1/10 boyutundaki modellerin işletmeler için son derece faydalı olabileceğini kanıtlıyoruz.” dedi.

Bu gelişmeler, AI’nın çevresel etkileri ve hesaplama maliyetleri konusundaki büyüyen endişelerle de örtüşmektedir. Hugging Face’in bu yeniliği, görsel-dil AI için gereken kaynakları dramatik şekilde azaltarak, her türlü işletme için gelişmiş AI yeteneklerini erişilebilir hale getirebilir.

Modeller açık kaynaklı olarak sunulmuş, Hugging Face’in AI teknolojisine erişimi artırma geleneğini sürdürmüştür. Bu erişilebilirlik, modellerin verimliliği ile birleştiğinde, sağlık hizmetleri ve perakende gibi maliyetlerin genellikle engelleyici olduğu endüstrilerde görsel-dil AI’nın benimsenmesini hızlandırabilir.

Yıllardan beri büyüklüğün, kalitenin göstergesi olarak görüldüğü bir alanda, Hugging Face’in başarısı yeni bir paradigmayı öneriyor: AI’nın geleceği, devasa veri merkezlerinde çalışan, her geçen gün daha büyük hale gelen modellerde değil, elimizdeki cihazlarda çalışan, çevik ve verimli sistemlerde olabilir. Sektör, ölçek ve sürdürülebilirlik konularıyla boğuşurken, bu küçük modeller belki de en büyük yenilikleri temsil ediyor.