Büyük dil modellerinin (LLM) işlem gücü ihtiyacı, model boyutlarının artışı, gerçek zamanlı gecikme gereksinimleri ve son zamanlarda yapay zeka akıl yürütmesi ile birlikte hızla büyüyor. Aynı zamanda, yapay zeka benimsemesi arttıkça, bir yapay zeka fabrikasının mümkün olduğunca çok kullanıcıya hizmet etme yeteneği, her kullanıcı için iyi deneyimleri sürdürerek elde edilen değerin maksimize edilmesi için kritik. En yeni modellerde yüksek tahmin verimliliği ve düşük gecikme süresi sağlamak, teknoloji yığınında mükemmellik gerektiriyor; bu, silikon, ağ sistemleri ve yazılımı kapsıyor.

MLPerf Inference v5.0, farklı modeller ve kullanım durumları için tahmin verimliliğini ölçen son sürüm bir kıyaslama aracıdır. İlk olarak 2019’da tanıtılmış olan MLPerf Inference, sürekli olarak yeni modeller ve senaryolar ile güncellenerek yapay zeka hesaplama platformlarının performansını ölçmede yardımcı bir araç olmayı sürdürmektedir.

Bu yeni versiyon, üç yeni kıyaslama eklemektedir:

- Llama 3.1 405B: 405 milyar parametreli yoğun bir LLM. Sunucu senaryosu için, ilk token için geçiş süresi (TTFT) için 6 saniye ve her çıktı tokenı için geçen zaman (TPOT) için 175 ms’lik gecikme gereklilikleri belirlenmiştir.

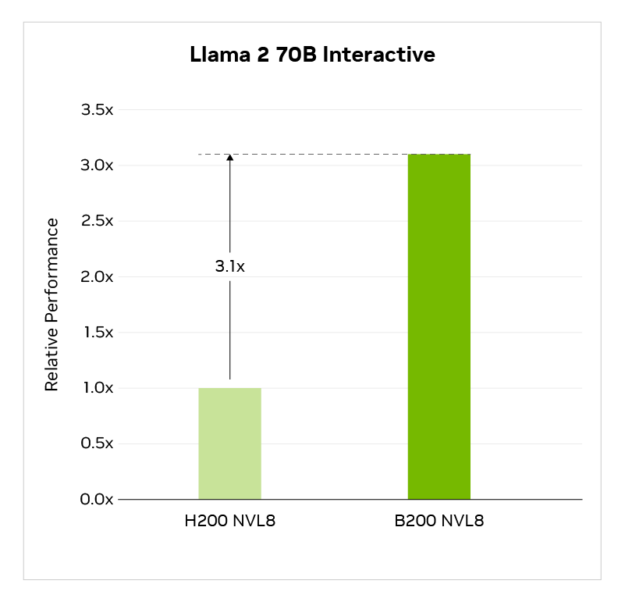

- Llama 2 70B Etkileşimli: 70 milyar parametreli yoğun LLM. Bu iş yükü, MLPerf Inference v4.0’daki Llama 2 70B modeline dayanmaktadır; ancak daha katı gecikme gereksinimlerine sahiptir: TTFT için 450 ms ve TPOT için 40 ms (kullanıcı başına saniyede 25 token).

- İlişkisel Grafik Dikkat Ağı (R-GAT):Geniş bir yelpazede uygulama alanları bulunan bir grafik sinir ağı kıyaslamasıdır; sosyal ağ analizi, ilaç keşfi, dolandırıcılık tespiti ve moleküler kimya gibi alanlarda kullanılmaktadır.

Bu yeni kıyaslamalar, ResNet-50, RetinaNet, 3D U-Net, DLRMv2, GPT-J, Stable Diffusion XL, Llama 2 70B ve Mixtral 8x7B gibi çeşitli modeller ve durumları kapsayan pek çok geri dönen kıyaslama ile bir araya gelmektedir.

NVIDIA, veri merkezi kategorisindeki her kıyaslama için sonuçlar sunarak, her alanda mükemmel performans sergilemiştir. Bu yeni eklenen Llama 3.1 405B, Llama 2 70B Etkileşimli ve GNN testlerinde de yeni performans sonuçları elde edilmiştir. Bu turda, NVIDIA, NVIDIA GB200 NVL72 ve NVIDIA DGX B200 kullanarak Blackwell mimarisi üzerinde birçok sonuç sunmuştur ve öncekine göre önemli hız artışları sağlamıştır. Hopper mimarisi ise üç yıl sonra da mükemmel performansını sürdürmeye devam etmiştir; bu, o GPU ailesi için performansı artırmaya devam eden yazılım iyileştirmeleri ile teşvik edilmiştir.

Blackwell, MLPerf’de Yeni Performans Standartını Belirliyor

NVIDIA Blackwell mimarisi, NVIDIA GTC 2024’te tanıtıldı ve büyük bulut hizmet sağlayıcıları ile geniş sayıda sunucu üreticisi tarafından tam üretim aşamasına geçmiştir. Blackwell, hem eğitim hem de tahmin için dramatik olarak daha yüksek performans sağlayan ikinci nesil Transformer Engine, beşinci nesil NVLink, FP4 ve FP6 hassasiyetleri gibi birçok mimari yenilik içermektedir.

Blackwell platformu, veri merkezi dağıtım gereksinimlerini karşılamak için çeşitli sistem şekilleriyle mevcuttur. NVIDIA, NVLink ve NVSwitch” ile tamamen bağlı olan 36 Grace CPU ve 72 Blackwell GPU içeren bir rack ölçekli sistem olan GB200 NVL72’yi ve NVLink ile NVSwitch kullanarak sekiz Blackwell GPU içeren DGX B200’ü kullanarak sonuçlar sunmuştur.

Bu turda, Llama 3.1 405B, Llama 2 70B Etkileşimli, Llama 2 70B ve Mixtral 8x7B benchmarkları için yapılan Blackwell başvurularında, ikinci nesil Transformer Engine, NVIDIA TensorRT-LLM yazılımı ve FP4 quantizasyon için TensorRT Model Optimizer kullanılmıştır. Bu teknolojilerin birleşimi, Blackwell’de FP4 hassasiyetinin %50 daha yüksek tepe verimliliği sunmasına imkan tanırken, benchmark doğruluğu gerekliliklerini de karşılamaktadır.

Llama 3.1 405B benchmarkında, GB200 NVL72, sekiz GPU sistemine kıyasla %3.4 daha yüksek performans göstermiştir.

MLPerf Training v5.0 sonuçları http://www.mlcommons.org üzerinden 2 Nisan 2025’te, 5.0-0058 ve 5.0-0060 numaralı kayıtlarla alınmıştır. GPU başına performans, MLPerf Inference v5.0’ın birincil bir metriği değildir; raporlanan verimliliğin hızlandırıcı sayısına bölünmesiyle elde edilmiştir. MLPerf adı ve logosu, ABD ve diğer ülkelerde MLCommons Derneği’nin ticari markalarıdır. Tüm hakları saklıdır. İzin vermeksizin kullanım kesinlikle yasaktır. Daha fazla bilgi için lütfen http://www.mlcommons.org adresini ziyaret edin.

GB200 NVL72, sistem düzeyinde, daha yüksek GPU performansı ve sistemdeki 9 kat daha fazla GPU ile bir araya gelerek %30’a kadar daha fazla performans artırımı sağlamaktadır. Hepsi tek bir NVLink alanında NVLink ve NVLink Switch ile bağlantılıdır.

MLPerf Training v5.0 sonuçları http://www.mlcommons.org üzerinden 2 Nisan 2025’te, 5.0-0058 ve 5.0-0060 numaralı kayıtlarla alınmıştır. MLPerf adı ve logosu, ABD ve diğer ülkelerde MLCommons Derneği’nin ticari markalarıdır. Tüm hakları saklıdır. İzin vermeksizin kullanım kesinlikle yasaktır. Daha fazla bilgi için lütfen http://www.mlcommons.org adresini ziyaret edin.

Ayrıca, NVIDIA, GB200 NVL72 üzerinde MLPerf Inference v4.1’deki Llama 2 70B benchmarkını çalıştırarak 869,203 tokens/saniye gibi bir doğrulanmamış sonuç elde etmiştir.

Llama 2 70B Etkileşimli benchmarkında, sekiz GPU’lu B200 sistemi, sekiz H200 GPU kullanan NVIDIA başvurusuna göre %3.1 daha yüksek verimlilik elde etmiştir.

MLPerf Inference v5.0, Kapalı, Veri Merkezi. Sonuçlar 2 Nisan 2025 tarihinde www.mlcommons.org üzerinden alınmıştır. Sonuçlar 5.0-0056 ve 5.0-0060 numaralı kayıtlar ile elde edilmiştir. MLPerf adı ve logosu, ABD ve diğer ülkelerde MLCommons Derneği’nin ticari markalarıdır. Tüm hakları saklıdır. İzin vermeksizin kullanım kesinlikle yasaktır. Daha fazla bilgi için lütfen http://www.mlcommons.org adresini ziyaret edin.

B200, Llama 2 70B, Mixtral 8x7B ve Stable Diffusion XL üzerinde de önemli hız artışları sağlamıştır.

| Benchmark | 8x Blackwell GPU Sunucu | Offline |

8x H200 GPU Sunucu | Offline |

Blackwell Hızlandırmaları Sunucu | Offline |

| Llama 2 70B Tokens/saniye |

98,443 | 98,858 | 33,072 | 34,988 | 3x | 2.8x |

| Mixtral 8x7B Tokens/saniye |

126,845 | 128,148 | 61,802 | 62,630 | 2.1x | 2.1x |

| Stable Diffusion XL Örnekler/saniye | Sorgular/saniye |

28.44 | 30.38 | 18.30 | 18.99 | 1.6x | 1.6x |

MLPerf Inference v5.0, Kapalı, Veri Merkezi. Sonuçlar 2 Nisan 2025 tarihinde www.mlcommons.org üzerinden alınmıştır. Sonuçlar 5.0-0056 ve 5.0-0060 numaralı kayıtlar ile elde edilmiştir. MLPerf adı ve logosu, ABD ve diğer ülkelerde MLCommons Derneği’nin ticari markalarıdır. Tüm hakları saklıdır. İzin vermeksizin kullanım kesinlikle yasaktır. Daha fazla bilgi için lütfen http://www.mlcommons.org adresini ziyaret edin.

Hopper, Mükemmel Performans Sunmaya Devam Ediyor

2022 Martında tanıtılan Hopper platformu, MLPerf Inference v5.0’daki her benchmarkta mükemmel bir tahmin performansı sunmaya devam etmiştir. Bulut hizmet sağlayıcıları ve işletmeler, hızlandırılmış altyapı yatırımlarının ömrünü maksimize etmek istediklerinde, bir platformun yeni yapay zeka modellerini ve kullanım durumlarını desteklemedeki yeteneği hayati önem taşımaktadır. Aynı zamanda, bir yapay zeka fabrikasının tahmin verimliliği, altyapının aynı model için tahmin verimliliğini artırarak, token üretim maliyetlerini azaltabileceği ve yapay zeka gelir potansiyelini artırabileceği anlamına gelir.

Llama 2 70B benchmarkında, NVIDIA H100 Tensor Core GPU performansı, yazılım optimizasyonları ile %1.5 oranında artış gösterdi. Bu optimizasyonlar; GEMM ve dikkat çekirdek optimizasyonları, gelişmiş çekirdek birleştirmeleri, parça bazında ön yükleme ve daha fazlasını içeriyor. Ayrıca, TensorRT-LLM’deki pipeline paralelliği iyileştirmeleri, Llama 2 70B throughput’ünü artırarak önemli bir rol oynamıştır.

Hopper mimarisi, her GPU’nun diğer GPU ile tam bant genişliğinde iletişim kurmasına olanak tanıyan bir NVLink Switch içermektedir. Bu özellik, geliştiricilerin belirli bir gecikme kısıtlaması için tahmin verimliliğini artırmanın en iyi yollarını seçme esnekliği sunar. NVLink Switch ile iletişim, daha fazla verimlilik için GEMM hesaplaması ile küçük ölçekte örtüşür, bu da Llama 3.1 405B throughput’unu H200 NVL8’de artırır.

Bu sürekli optimizasyonların sonucu olarak, Hopper, MLPerf’in en son ve en zorlu iş yükleri olan Llama 3.1 405B ve Llama 2 70B Etkileşimli üzerinde mükemmel performans sergilemiştir.

NVIDIA, Mixtral 8x7B benchmarkında sonuçlarını sunan tek platform olmuştur ve Hopper üzerindeki performans, önceki tura göre artmıştır. Ayrıca GPT-J benchmarkındaki performans yeni bir artırımla, ilk başlatıldığı günden bu yana offline senaryoda %2.9 ve sunucu senaryosunda %3.8’lik toplam bir artış sağlamıştır.

Sonuç

NVIDIA, MLPerf Training’deki en son turda gösterilen gibi, eğitim ve MLPerf Inference’de lider performans sergilemektedir. Üç yıl sonra Hopper platformu endüstrinin önde gelen platformlarından biri olmaya devam etmekte ve sürekli olarak tam yığın optimizasyonları sayesinde mevcut yapay zeka kullanım durumlarında performans artışları sunmaktadır ve yeni durumları desteklemekte, yüksek bir hizmet ömrü sunmaktadır.

NVIDIA Blackwell, performans ve enerji verimliliği konusunda yeni standartlar belirlemekte; bu, yapay zeka fabrikalarının gelir ve karlılığını etkileyen temel faktörlerdir. Mevcut iş yüklerinde büyük performans artışları sunmanın yanı sıra, daha talepkar senaryolar için daha büyük kazanımlar sağlamayı mümkün kılarak, Blackwell yeni yapay zeka yeniliklerinin dalgasını mümkün kılmaktadır.

Ayrıca, NVIDIA, Hopper ve Blackwell GPU’ları üzerinde çalışan Dynamo ile yapay zeka akıl yürütmesini ölçeklendirmektedir.

Teşekkürler

Bu olağanüstü sonuçlara ulaşmada birçok NVIDIA çalışanının katkıları büyük olmuştur. Kefeng Duan, Shengliang Xu, Yilin Zhang, Robert Overman, Shobhit Verma, Viraat Chandra, Zihao Kong, Tin-Yin Lai ve Alice Cheng gibi birçok ismin özverili çalışmaları için teşekkür ederiz.

NVIDIA MLPerf v4.1 kodu kullanılarak elde edilen sonuçlar TensorRT-LLM 0.18.0.dev ile elde edilmiştir. Doğrulanmamış MLPerf v4.1 Inference Kapalı Llama 2 70B offline. Sonuç, MLCommons Derneği tarafından doğrulanmamıştır. Doğrulanmamış sonuçlar, MLPerf incelemesinden geçmemiştir ve doğrulanmış sonuçlar için MLPerf spesifikasyonlarıyla uyumsuz olabilecek ölçüm metodolojileri ve/veya iş yükü uygulamaları kullanabilir. MLPerf adı ve logosu, ABD ve diğer ülkelerde MLCommons Derneği’nin ticari markalarıdır. Tüm hakları saklıdır. İzin vermeksizin kullanım kesinlikle yasaktır. Daha fazla bilgi için lütfen www.mlcommons.org adresini ziyaret edin.