NVIDIA DGX Cloud Serverless Inference, uygulamaların hızlı ve güvenilir bir şekilde dağıtılmasını sağlayan otomatik ölçekleme özelliğine sahip bir AI çıkarım çözümü‘dür. NVIDIA Cloud Functions (NVCF) ile güçlendirilen DGX Cloud Serverless Inference, çoklu bulut ve yerel ortamlar arasında GPU hızlandırmalı iş yükleri için çoklu küme altyapı kurulumlarını soyutlamaktadır. AI iş yükleri, yüksek performanslı hesaplama (HPC), AI simülasyonları veya konteynerleştirilmiş uygulamaları yönetirken, platform her yerde ölçeklenmeyi mümkün kılar, altyapıyı soyutlar. Bir kez dağıtıp her yerde ölçeklendirin.

Bağımsız Yazılım Sağlayıcıları (ISV), genellikle AI uygulamalarını dağıtırken ve ölçeklendirirken zorluklarla karşılaşır. Bu uygulamalar, dünya genelinde veya müşteri altyapısına yakın bir şekilde dağıtılması gerekebilir. Bu durum, birden fazla bulut, veri merkezi ve coğrafya arasında dağıtım yapmayı gerektirerek karmaşık altyapı operasyonlarına yol açar. Serverless AI çıkarımı, altyapı yönetimini basit, kullanıcı dostu ve tutarlı bir şekilde nasıl yapılacağı konusunda ISV’lere yardımcı olarak bu zorluğu aşar.

Olağanüstü Esneklik ve Kolaylık

NVIDIA DGX Cloud Serverless Inference, hesaplama altyapısının yatay bir toplayıcısı olarak işlev görür. ISV’ler, NVIDIA, NVIDIA Bulut Ortakları, özel bir bulut hizmet sağlayıcısından (CSP) veya kendi yerel kapasitelerinden gelen kaynakları sorunsuz bir şekilde karıştırabilir. İsterseniz geçici olarak kapasiteyi artırabilir veya yeni bulut sağlayıcılarını test edebilirsiniz; bu çözüm eşsiz bir esneklik sunar.

Kapsamlı Yetenekler ve Uygulama

Bu yazıda, NVIDIA DGX Cloud Serverless Inference’ın geliştiricilere, küresel yük dengelemesi, otomatik ölçekleme ve multicloud esnekliği ile AI, grafik ve iş yükleri üzerinde tek bir API uç noktası kullanarak nasıl kesintisiz bir şekilde ölçeklendirme sağladığını açıklayacağız.

Hem Hız Hem de Verimlilik

DGX Cloud Serverless Inference, geliştiricilerin ve ISV’lerin en iyi bildikleri şeye odaklanmalarını sağlar: uygulama geliştirmeye. NVCF, bu uygulamaların teslimatını ve ölçeklenmesini basit bir şekilde gerçekleştirmekte, GPU yönetimi veya altyapı işlemleri ile ilgili endişeleri ortadan kaldırmaktadır. Bununla birlikte elde edilen bazı önemli faydalar şunlardır:

- Altyapı ve operasyonel yükün azaltılması: Uygulamaları, tek bir bütünleşik, otomatik ölçeklenen hizmet ile müşteri altyapısına daha yakın şekilde dağıtma imkanı.

- İş büyümesi için esneklik: Patlama veya kısa süreli iş yüklerini desteklemek için hızla hesaplama kapasitesi ekleyin.

- Kolay geçiş seçenekleri: Mevcut hesaplama düzenlemelerini, kendi hesaplama kapasitenizi sunan bir platforma entegre etmenizi sağlar.

- Riske kapalı keşif: Yeni coğrafyalarda, sağlayıcılarda veya GPU türlerinde deneme yapma imkanı sunarak uzun vadeli yatırımlara bağlı kalmanızı engeller. Verilerin yurtseverliği, düşük gecikme süreleri ve daha düşük maliyetler gibi kullanımları destekler.

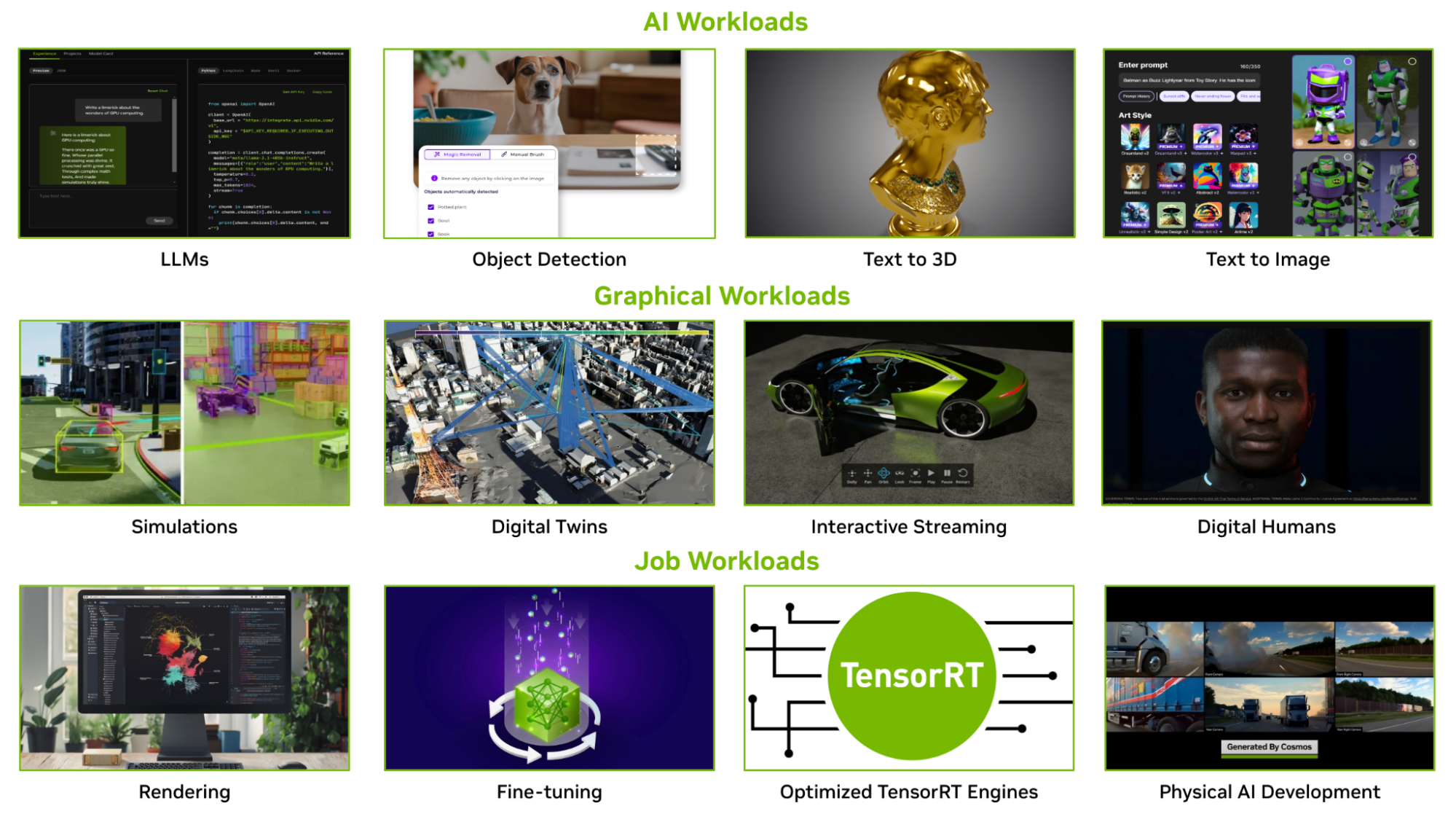

Hangi İş Yükleri Çalıştırılabilir?

DGX Cloud Serverless Inference, AI, grafik ve iş yükleri dahil olmak üzere pek çok konteynerleştirilmiş iş yükünü desteklemektedir (Şekil 2). Bu iş yükleri, build.nvidia.com üzerinde çalışan NVIDIA AI iş yüklerini veya NVIDIA Omniverse gibi simülasyon iş yüklerini içermektedir.

AI İş Yükleri

Keskin büyük dil modelleri (LLMs) üzerinde çalışmak için tasarlanmıştır; bu modellerin büyük bir kısmı tek düğümlere sığmayacak şekilde büyük olup çok düğümlü çıkarım gerektiren uygulamaları içerir. DGX Cloud Serverless Inference, bu tür iş yüklerini yönetirken mükemmeldir:

- Nesne tespiti

- Görüntü, 3D ve video üretimi

- Gelişmiş makine öğrenimi modelleri

Grafiksel İş Yükleri

NVIDIA, grafik hesaplama alanında uzmanlaşmıştır ve bu nedenle platform, grafik yoğun görevler için özel olarak tasarlanmıştır. Desteklediği grafiksel iş yükleri, şunları kapsar:

- Dijital ikizler ve simülasyonlar

- Etkileşimli akış hizmetleri

- Dijital insan ve robotik iş akışları

Grafik iş yükleri için optimize edilmiş hesaplama ile, DGX Cloud Serverless Inference, performansı artırmak için Omniverse veya NVIDIA Aerial gibi teknolojilerle sorunsuz bir şekilde entegrasyon sağlar.

İş Yükleri

DGX Cloud Serverless Inference, tamamlanmaya yönelik “run-to-completion” iş yüklerinin mükemmel bir çözümüdür. Görüntü işleme veya AI modellerinin ince ayarlarının yapılması gibi işler için kaynakların etkin bir şekilde kullanılmasını sağlar. Kullanım senaryoları arasında:

- NVIDIA TensorRT motor optimizasyonu

- Fiziksel AI model eğitimi video veri üretimiyle

DGX Cloud Serverless Inference Kullanarak Başlamak

DGX Cloud Serverless Inference üzerinde bir iş yükü çalıştırmak için birden fazla yol bulunmaktadır. Şekil 1’de gösterildiği gibi, en hızlı ve en kolay yol, NVIDIA NIM mikroservis konteynerlerini ve NVIDIA Blueprints kullanmaktır. DGX Cloud Serverless Inference, kullanıcı arayüzünde elastik NIM yeteneklerini barındırarak bu optimize edilmiş modelin ölçeklendirilmesini kolaylaştırır.

Bununla birlikte, ISV’ler özel bir konteyner kullanarak DGX Cloud Serverless Inference’in otomatik ölçekleme ve küresel yük dengelemesini otomatik olarak gerçekleştirmesine olanak tanıyabilir. Ayrıca, daha karmaşık dağıtımlar için Helm grafiklerini de kullanabilirler.

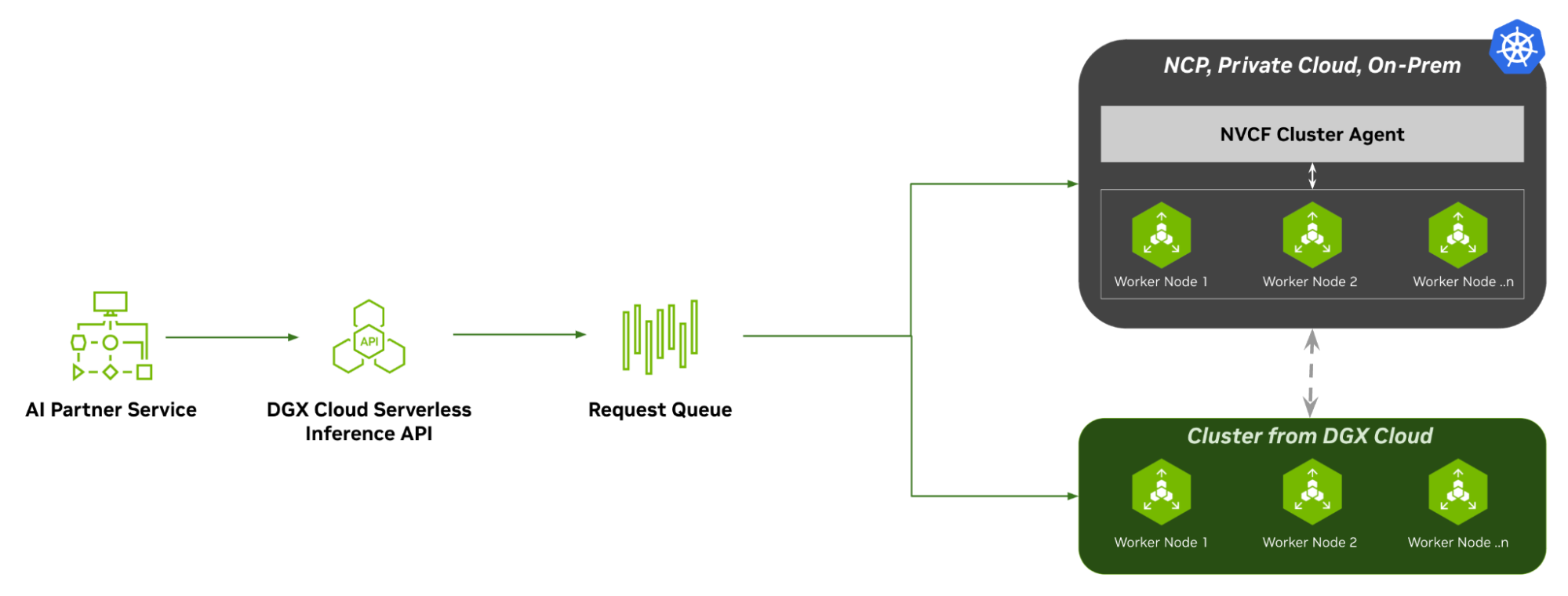

İş yükü DGX Cloud Serverless Inference’a dağıtıldıktan sonra, ISV uygulaması modeli bir API uç noktasından çağırabilir. DGX Cloud Serverless Inference, bu API uç noktasının arkasında bulunan hesaplama kümelerini soyutlar. Bu API, çağrı taleplerini bir geçide ve küresel bir istek kuyruğuna yönlendirir ve optimum yük dengelemesi için birden fazla bölgesel kuyruk kullanabilir. ISV, API uç noktasının arkasında birden fazla kümeyi karıştırma ve eşleştirme imkanı bulur.

Örneğin, Şekil 3, bir ISV’nin iki farklı sağlayıcıdan iki farklı küme kullandığı bir senaryoyu gösterir. Bu sağlayıcılardan biri, bir NVIDIA Cloud Partner ya da ISV’nin CSP’deki özel bulutudur. NVIDIA Cluster Agent (NVCA) yazılımı bu küme içinde kurulu olup, bu kümedeki hesaplama kaynaklarını görünür hale getirir ve iş yükünü hizmet verme amacıyla kullanılabilir hale getirir. Diğer sağlayıcı ise, DGX Cloud’dan sağlanan rezerve veya talep üzerine hesaplamadır. ISV, benzersiz iş ihtiyaçlarına bağlı olarak küme yapılandırmalarının herhangi bir kombinasyonunu kullanabilir.

Küme etiketleri ile, dağıtımları hedeflemek için belirli niteliklerle işaretlenebilir. Örneğin, bir dağıtım yalnızca belirli bir coğrafyadaki, grafik optimize edilmiş, önbellek desteği olan veya belirli bir sertifikayı (örneğin, SOC2, HIPAA) karşılayan kümelere hedeflenebilir. Bu durum, ISV’lerin iş yüklerinin nerelerde çalıştırılacağını kontrol etmelerini sağlar. Daha fazla detay için Function Deployment belgeleri‘ni inceleyebilirsiniz.

Son olarak, DGX Cloud Serverless Inference API’si, nasıl kullanılacağı açısından en üst düzeyde esneklik sağlar. API, yalnızca URL ve yetkilendirme başlığı açısından belirleyicidir; yük gövdesi, iş yükünün ihtiyaçlarını karşılayacak şekilde özelleştirilebilir. Örneğin, LLM söz konusu olduğunda yük, OpenAI sohbet tamamlama API formatına uygun olarak ayarlanabilir. ISV geliştirici, HTTP Polling, HTTP Streaming ve gRPC kullanma esnekliğine de sahiptir. Daha fazla bilgi için API belgeleri‘ni kontrol edebilirsiniz.

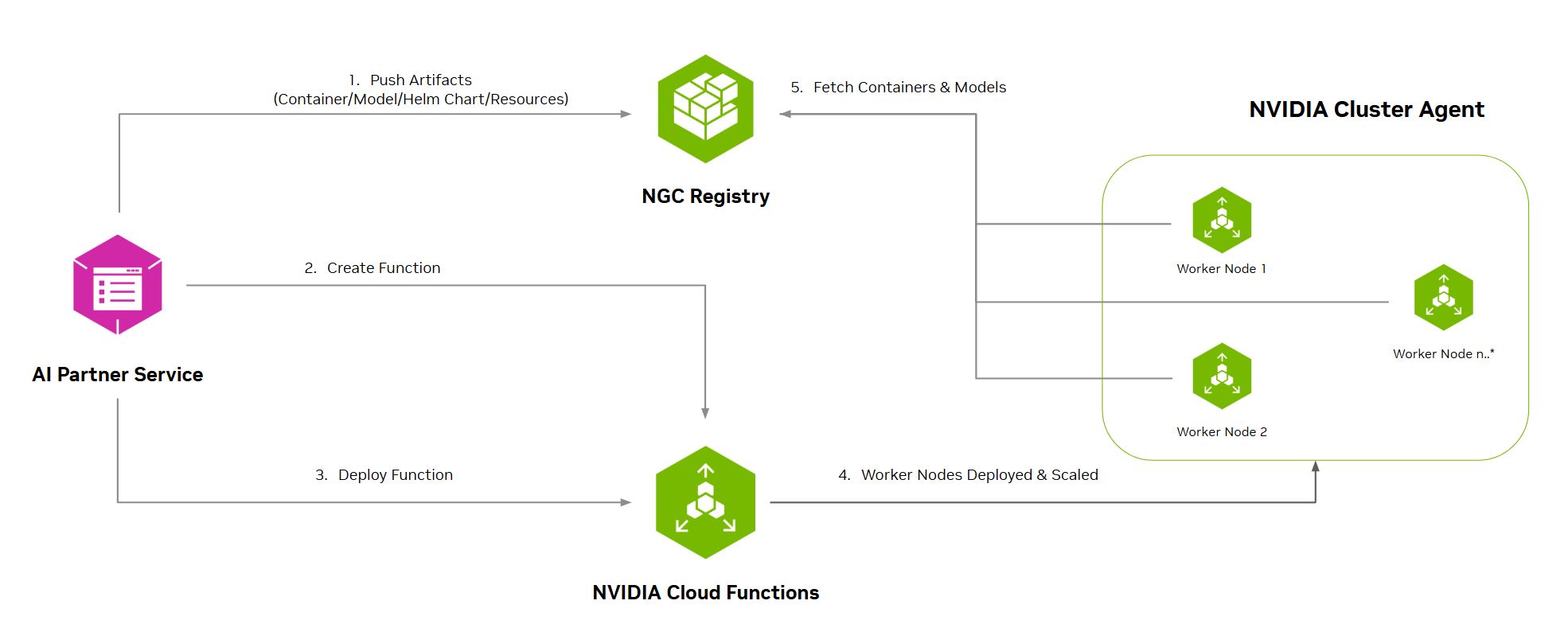

Fonksiyonlar Nasıl Dağıtılır?

NVIDIA Cloud Functions (NVCF), DGX Cloud Serverless Inference’ın kontrol düzlem katmanıdır. NVIDIA küme ajansları, küme kayıt işlemi için işçi düğümleri üzerinde kurulu olarak kontrol düzlemi ile iletişim kurar. Bu, AI çıkarım iş yüklerinin kesintisiz dağıtımını ve ölçeklenmesini sağlar. Dağıtım süreci aşağıdaki adımları takip eder (Şekil 4):

- NGC Kayıt Defterine öğeleri gönderin: AI geliştiricileri veya hizmet sağlayıcıları, konteynerler, AI modelleri, Helm grafikler ve diğer kaynaklar gibi gerekli varlıkları NVIDIA NGC Kayıt Defteri’ne gönderir. Bu, çıkarım için hazır varlıkları yönetmek için merkezi bir depo işlevi görür.

- Fonksiyonu oluşturun: AI Partner Service kullanarak kullanıcılar, AI modelinin veya hizmetinin nasıl çalışacağını tanımlayan bir fonksiyon oluşturur. Bu adım, altyapı yönetiminin karmaşık yönlerini soyutlar.

- Fonksiyonu dağıtın: Oluşturduktan sonra, fonksiyon mevcut hesaplama kaynakları üzerinde dağıtılır. NVCF, etkin bir biçimde dağıtımı yöneterek, çoklu GPU’lar arasında verimli bir şekilde çalışmasını sağlar.

- İşçi düğümleri dağıtılır ve ölçeklenir: NVCF, talebe bağlı olarak dinamik olarak işçi düğümlerini sağlamakta ve NVIDIA DGX Cloud veya ortak hesaplama ortamları arasında altyapıyı otomatik ölçeklendirmektedir.

- Konteynerleri ve modelleri al: İşçi düğümleri gerekli konteynerleri ve modelleri NGC Kayıt Defteri’nden alır ve en güncel sürümlerin çalıştığından emin olur.

Bu süreç, ISV’lerin ve geliştiricilerin AI yeniliğine odaklanmasını sağlar, altyapı yönetimini ortadan kaldırır ve otomatik ölçekleme, yüksek erişilebilirlik ve maliyet etkin GPU kullanımı avantajlarından faydalanmalarını sağlar.

ISV’ler Nasıl Kullanıyor?

DGX Cloud Serverless Inference, dünya çapında etkileşimli AI deneyimlerini, büyük ölçekli simülasyon ortamlarını ve daha fazlasını desteklemekte ve bu alanda öncülük etmektedir. Aşağıdaki ISV’ler, NVIDIA ön izleme programı aracılığıyla bu teknolojiyi kullanmaktadır:

- Aible: Veri mühendisliği ve makine öğrenimi iş akışlarını otomatikleştirerek işletmeler için ölçülebilir iş etkisi sunan AI destekli veri bilimi çözümleri sağlayıcısı. Aible, NVIDIA Cloud Functions Serverless GPU’ların, uçtan uca retrieval-augmented generation (RAG) çözümleri için TCO’yu %200 artırmada nasıl bir iyileşme sağladığını göstermiştir.

- Bria: %100 lisanslı verilerle eğitilmiş modeller sunan geliştiriciler için grafiksel jeneratif AI platformu, metinden görüntü üretimi için inferans ihtiyaçlarını ölçeklendirmek amacıyla NVIDIA Cloud Functions’u kullanmaktadır. Bria, NVIDIA L40S ve NVIDIA H100 GPU’ları kullanarak talep üzerine GPU’ları tüketerek toplam sahip olma maliyetlerini düşürmektedir.

- Cuebric: Film yapımcıları ve yaratıcıların, kavramları birkaç dakikada fotorealist, film hazır sanal ortamlar ve arka planlara dönüştürmesine olanak tanıyan jeneratif bir AI aracı. Cuebric, AI iş yüklerini küresel ölçekte ölçeklendirmek ve talep üzerine patlamak için NVIDIA Cloud Functions’ı kullanmaktadır.

- Outerbounds: ML, AI ve veri bilimcileri için altyapı ve araç sağlayıcısıdır. Outerbounds, müşterilerine NVIDIA Cloud Functions üzerinde, talep üzerine ölçekleştirilebilen GPU altyapısı sunmaktadır. Maliyetleri düşürmek için, NVIDIA Cloud Functions’un hızlı soğuk başlatma süresiyle sıfıra ölçeklenebilir örneklerden yararlanmaktadır.

Gelişmiş algılama sistemlerinden yüksek çözünürlüklü simülasyonlara, dinamik AI iş yüklerine kadar DGX Cloud Serverless Inference, optimal performans ve kaynak tahsisi sağlayarak kullanıcıların ihtiyaçlarını karşılamaktadır.

DGX Cloud Serverless Inference ile Başlayın

ISV’ler ve NVIDIA Cloud Ortakları, şimdi DGX Cloud Serverless Inference’ı deneme fırsatına sahiptirler. ISV’ler için, DGX Cloud Serverless Inference’ın farklı hesaplama sağlayıcılarına geçiş yaparken düşük riskli bir yol sunabilir. Bu, ISV’nin özel bulutundan veya NVIDIA Cloud Ortaklarından hesaplama sağlarken, DGX Cloud Serverless Inference’ın farklı hesaplama sağlayıcıları arasında bir “çeviri katmanı” işlevi görmesini sağlar.

NVIDIA Cloud Ortakları için, DGX Cloud ortağı olarak kayıt olmak, ISV’lerin adaptasyonunu kolaylaştırabilir ve ISV’lerin, özel bulutlarından veya DGX Cloud hesaplama ortamlarından, önde gelen NVIDIA Cloud Ortakları tarafından sağlanan hesaplmalara daha sorunsuz bir geçiş yapmalarına olanak tanır.

Daha fazla bilgi edinmek ve 30 günlük bir deneme için kaydolmak için DGX Cloud Serverless Inference sayfasını ziyaret edin.