Görsel verilerin, görüntülerden PDF’lere ve akış videolarına kadar uzanan hızlı büyümesi, manuel inceleme ve analiz süreçlerini neredeyse imkansız hale getiriyor. Kurumlar, bu verileri ölçekli bir şekilde eyleme dönüştürmekte zorlanıyor, bu da fırsatların kaçırılmasına ve artan risklere yol açıyor.

Bu zorluğun üstesinden gelmek için görsel-dil modelleri (VLM’ler) güçlü araçlar olarak ön plana çıkmaya başladı. VLM’ler, görsel algıyı metin tabanlı akıl yürütme ile birleştiriyor. Geleneksel büyük dil modelleri (LLM’ler) yalnızca metni işleyebildiğinden, VLM’ler karmaşık çok modlu verileri anlamak ve bunlarla harekete geçmek için görsel yapay zeka ajanları oluşturmanıza olanak tanıyor. Bu sayede gerçek zamanlı karar alma ve otomasyon sağlanıyor.

Hayal edin; uzak kameraların görüntülerini analiz ederek orman yangınlarının erken belirtilerini tespit eden veya iş belgelerini tarayarak grafikler, tablolar ve görüntüler arasında gömülü önemli bilgileri çıkaran akıllı bir yapay zeka ajanınız var—tüm bunlar, tamamen bağımsız bir şekilde gerçekleştiriliyor.

NVIDIA NIM mikro hizmetleri ile bu ileri düzey görsel yapay zeka ajanlarını oluşturmak artık her zamankinden daha kolay ve verimli. Esnek özelleştirme, kolay API entegrasyonu ve sorunsuz dağıtım sunan NIM mikro hizmetleri, çeşitli iş ihtiyaçlarınıza uygun dinamik ajanlar yaratmanızı sağlıyor.

Görsel Yapay Zeka Modellerinin Türleri

Sağlam bir görsel yapay zeka ajanı oluşturmak için aşağıdaki temel görsel modelleri kullanabilirsiniz:

- VLM’ler

- Gömme modelleri

- Bilgisayarla Görme (CV) Modelleri

Bu modeller, akıllı görsel yapay zeka ajanları geliştirmenin temel yapı taşlarıdır. VLM, her ajan için temel motoru oluştururken, CV ve gömme modelleri, nesne tespiti veya karmaşık belgeleri çözmek gibi görevlerde doğruluğu artırarak yeteneklerini geliştirebilir.

Bu yazıda, görsel NIM mikro hizmetlerinden yararlanarak bu modelleri nasıl erişeceğinizi öğreteceğiz. Her bir görsel NIM mikro hizmeti, iş akışlarınıza kolay entegrasyon sağlamak için basit REST API’leri aracılığıyla kullanılabilir; bu da metin, görüntü ve videolar üzerinde verimli model çıkarımı yapmanıza olanak tanır. Başlamak için, yerel bir GPU’ya ihtiyaç duymadan build.nvidia.com üzerinde barındırılan önizleme API’leriyle denemeler yapabilirsiniz.

Görsel-Dil Modelleri

VLM’ler, dil modellerine yeni bir boyut katarak görsel yetenekler ekleyerek çok modlu hale getiriliyor. Bu modeller, görüntüler, videolar ve metinleri işleyerek görsel verileri yorumlayabilir ve metin tabanlı çıktılar üretebilir. VLM’ler çok yönlüdür ve belirli kullanım durumları için özelleştirilebilir veya görsel girdilere dayalı olarak soru-cevap gibi görevler için yönlendirilebilir.

NVIDIA ve ortakları, her biri boyut, gecikme ve yetenek açısından farklılık gösteren birkaç VLM’yi NIM mikro hizmetleri olarak sunuyor (Tablo 1).

| Şirket | Model | Boyut | Açıklama |

| NVIDIA | VILA | 40B | Küçük bir artık tüketimi olan genel amaçlı güçlü bir modeldir. |

| NVIDIA | Neva | 22B | NVGPT ve CLIP’i birleştiren orta boy bir modeldir. |

| Meta | Llama 3.2 | 90B/11B | Görsel yetenekleri olan ilk Llama modelidir. |

| Microsoft | phi-3.5-vision | 4.2B | Hızlı bir model olup OCR konusunda uzmandır. |

| Microsoft | Florence-2 | 0.7B | Basit metin istemleri kullanarak çok yönlü görevleri gerçekleştirebilen bir modeldir. |

Gömme Modelleri

Gömme modelleri, giriş verilerini (görüntüler veya metin gibi) yoğun, özellik açısından zengin vektörlere dönüştürür. Bu gömmeler, verideki temel özellikleri ve ilişkileri kapsayarak benzerlik araması veya sınıflandırma gibi görevleri kolaylaştırır. Gömme modelleri genellikle vektör veritabanlarında depolanır, bu da GPU hızlandırmalı arama ile ilgili verilerin hızlı bir şekilde geri alınmasını sağlar.

Gömme modelleri, akıllı ajanlar oluştururken kritik bir rol oynar. Örneğin, geri alma destekli üretim (RAG) iş akışlarını destekleyerek ajanın, farklı veri kaynaklarından ilgili bilgileri çekmesine ve bağlamda öğrenme yoluyla doğruluğunu artırmasına olanak tanır.

| Şirket | Model | Açıklama | Kullanım Alanları |

| NVIDIA | NV-CLIP | Metin ve görüntü gömmeleri üreten çok modlu bir temel modeldir. | Çok modlu arama, sıfırdan sınıflandırma |

| NVIDIA | NV-DINOv2 | Yüksek çözünürlüklü görüntü gömmeleri üreten bir görsel temel modeldir. | Benzerlik araması, birkaç örnekle sınıflandırma |

Bilgisayarla Görme Modelleri

CV modelleri, görüntü sınıflandırma, nesne tespiti ve optik karakter tanıma (OCR) gibi uzmanlaşmış görevler üzerine odaklanmaktadır. Bu modeller, VLM’lerin yeteneklerini zenginleştirerek detaylı meta veriler ekleyebilir ve yapay zeka ajanlarının genel zekasını artırabilir.

| Şirket | Model | Açıklama | Kullanım Alanları |

| NVIDIA | Grounding Dino | Açık sözlük nesne tespiti | Herhangi bir şeyi tespit eder |

| NVIDIA | OCDRNet | Optik karakter tespiti ve tanıma | Belge ayrıştırma |

| NVIDIA | ChangeNet | İki görüntü arasındaki piksel düzeyindeki değişiklikleri tespit eder | Hasar tespiti, uydu görüntü analizi |

| NVIDIA | Perakende Nesne Tespiti | Yaygın perakende ürünlerini tespit etmek için önceden eğitilmiş bir modeldir. | Kayıpların önlenmesi |

Görsel AI Ajanları Oluşturma

Görsel NIM mikro hizmetlerini kullanarak güçlü görsel yapay zeka ajanları oluşturma yolunda bazı gerçek dünya örnekleri. NIM mikro hizmetleri ile uygulama geliştirmeyi daha erişilebilir hale getirmek için, GitHub’da bir dizi örnek yayımladık. Bu örnekler, NIM API’lerini nasıl kullanacağınızı gösteriyor ve her bir örnek, GPU olmadan bile kolayca başlatılabilecek bir Jupyter notebook eğitimi ve demosu içeriyor.

NVIDIA API Kataloğu‘ndan bir model sayfası seçin, örneğin Llama 3.1 405B. API Anahtarı Al seçeneğini tıklayın ve iş e-postanızı girin, 90 günlük bir NVIDIA AI Enterprise lisansı için, veya kişisel e-postanız ile NVIDIA Geliştirici Programı aracılığıyla NIM’e erişebilirsiniz.

/NVIDIA/metropolis-nim-workflows GitHub deposunda Jupyter notebook eğitimlerini ve demolarını keşfedin. Bu iş akışları, görsel NIM mikro hizmetlerinin, güçlü AI ajanları oluşturmak için vektör veritabanları ve LLM’ler gibi diğer bileşenlerle nasıl birleştirilebileceğini gösteriyor. API anahtarınızla, bu yazıda gösterilen iş akışlarını kolayca yeniden oluşturarak, Görsel NIM mikro hizmetleri ile pratik deneyim kazanabilirsiniz.

İşte birkaç örnek iş akışı:

- VLM akış videosu uyarı ajanı

- Yapılandırılmış metin çıkarma ajanı

- NV-DINOv2 ile az örnekle sınıflandırma ajanı

- NV-CLIP ile çok modlu arama ajanı

VLM Akış Videosu Uyarı Ajanı

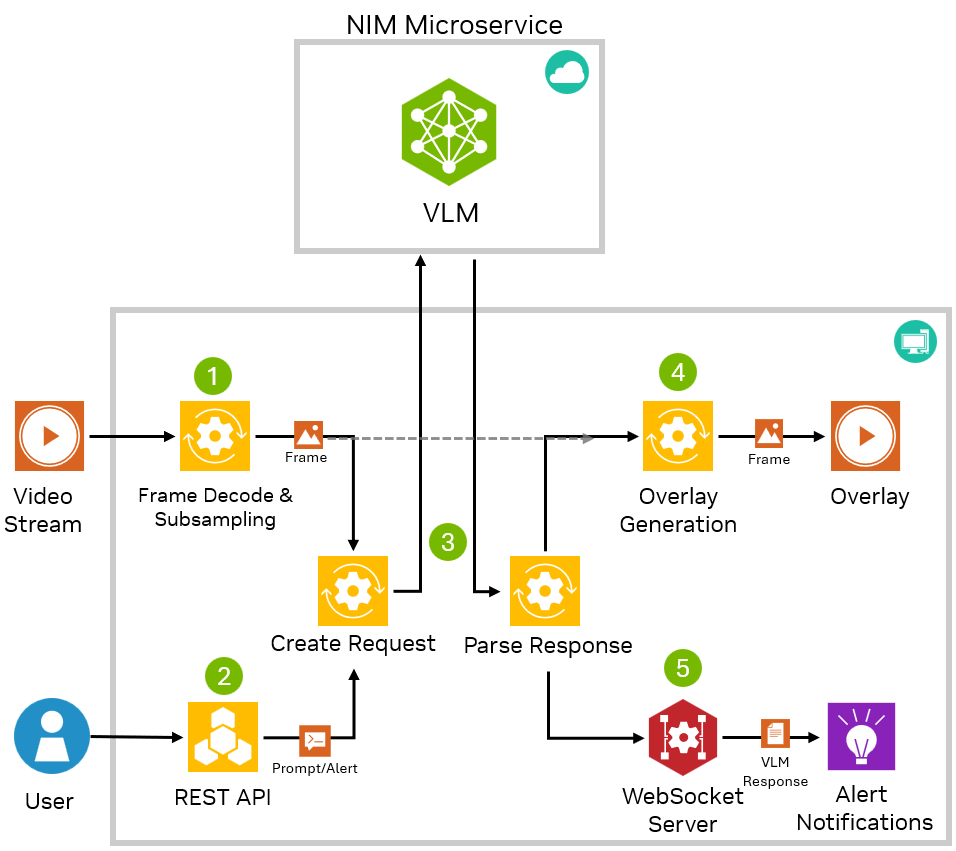

Büyük miktarda video verisi her saniye üretiliyor. Anahtar olayları, örneğin paket teslimatlarını veya orman yangınlarını manuel olarak incelemek imkansız hale geliyor. Bu iş akışı, kullanıcı tanımlı olayları bağımsız şekilde izleyen bir AI ajanı oluşturmak için VLM’leri, Python ve OpenCV’yi nasıl kullanacağınızı gösteriyor. Olay tespit edildiğinde, bir uyarı oluşturuluyor ve bu, birçok saatlik manuel video incelemesinden tasarruf sağlıyor. VLM’lerin esnekliği sayesinde, yeni olaylar, özel CV modelleri oluşturulmadan yalnızca istemleri değiştirerek tespit edilebilir.

Şekil 2’de VLM, bulutta çalışırken video akışlama hattı yerel olarak işletiliyor. Bu düzen, demonun neredeyse her donanımda çalışmasına olanak tanırken, ağır hesaplamaların bulut aracılığıyla NIM mikro hizmetleri ile üstlenilmesi sağlanıyor.

Bu ajanı oluştururken izlenecek adımlar:

- Video akışını yükleyin ve işleyin: OpenCV’yi kullanarak bir video akışını veya dosyasını yükleyin, çözün ve alt örnek çerçevelerini çıkartın.

- REST API uç noktaları oluşturun: Kullanıcıların özel istemler yazabileceği kontrol REST API uç noktaları oluşturmak için FastAPI’yi kullanın.

- VLM API’si ile entegrasyon: Bir sarmalayıcı sınıf, video çerçeveleri ve kullanıcı istemleri ile VLM API’si ile etkileşimi yönetir. NIM API isteklerini oluşturur ve yanıtı analiz eder.

- Cevapları videoya ekleyin: VLM yanıtı, video üzerine eklenerek OpenCV ile gerçek zamanlı izleme amaçlı akışa çıkarılır.

- Uyarıları tetikleyin: Ayrıştırılan yanıtı bir WebSocket sunucusu aracılığıyla diğer hizmetlerle entegre ederek algılanan olaylara dayanan bildirimleri tetikler.

VLM destekli akış videosu uyarı ajanı oluşturmaya dair daha fazla bilgi için /NVIDIA/metropolis-nim-workflows not defteri eğitimine ve demosuna GitHub’dan göz atın. Kullanım durumunuza en uygun modeli bulmak için farklı VLM NIM mikro hizmetleri ile denemeler yapabilirsiniz.

VLM’lerin, NVIDIA Jetson ve Jetson Platform Hizmetleri ile uç uygulamaları nasıl dönüştürebileceği hakkında daha fazla bilgi için, “Uçta Generatif AI Destekli Görsel AI Ajanları Geliştirme” makalesine bakabilirsiniz.

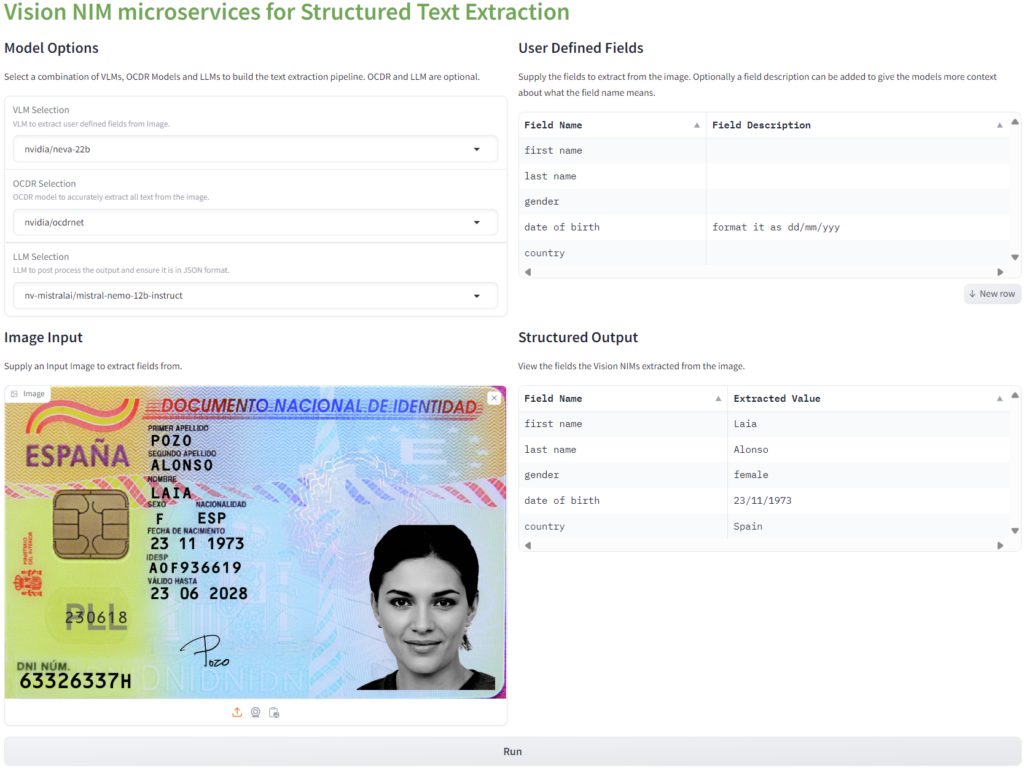

Yapılandırılmış Metin Çıkarma Ajanı

Birçok iş belgesi, PDF’ler gibi arama yapılabilir formatlar yerine görüntü olarak saklanmaktadır. Bu, bu belgeleri arama ve işleme konusunda önemli bir zorluk doğuruyor ve çoğu zaman manuel inceleme, etiketleme ve düzenleme gerektiriyor.

Görsel metin tespiti ve tanıma (OCR) modelleri mevcut olsa da, çoğu zaman geri dönen sonuçlar düzeni koruyamıyor ve görsel verileri yorumlamakta yetersiz kalıyor. Bu, her biri farklı şekiller ve boyutlarla sunulan kimlik kartları gibi düzensiz formatlı belgeler üzerinde çalışırken özellikle zorlu hale geliyor.

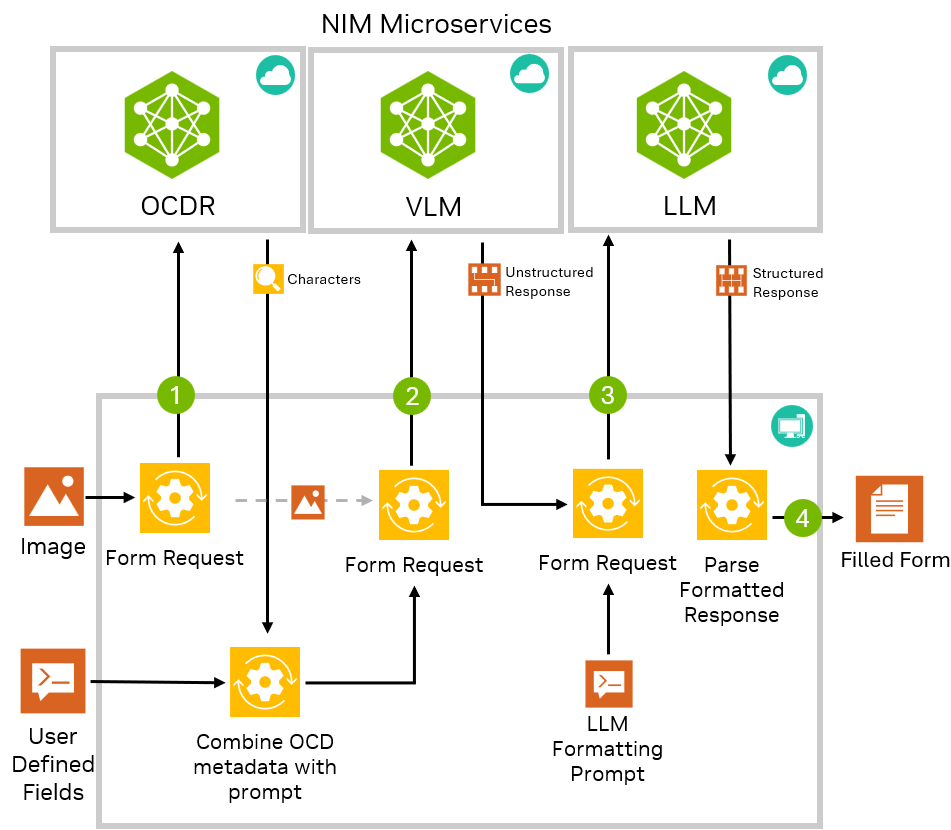

Geleneksel CV modelleri, bu tür belgeleri işleme sürecini zaman alıcı ve maliyetli kılıyor. Ancak, VLM’lerin ve LLM’lerin esnekliğini, OCR modellerinin hassasiyeti ile birleştirerek, belgeleri bağımsız bir şekilde ayrıştıran ve kullanıcının tanımladığı alanları bir veritabanına kaydeden güçlü bir metin çıkarma boru hattı oluşturabilirsiniz.

Yapılandırılmış metin çıkarma boru hattını oluşturma adımları:

- Belge girişi: Bir belge görüntüsünü bir OCR modeline, örneğin OCDRNet veya Florence’a sağlayın; bu, belgede tespit edilen tüm karakterler için meta verileri döner.

- VLM entegrasyonu: VLM, istenen alanları belirten kullanıcının istemini işler ve belgeyi analiz eder. OCR modelinden elde edilen karakterleri kullanarak daha doğru bir yanıt üretir.

- LLM biçimlendirmesi: VLM’nin yanıtı, verileri JSON formatında bir tablo şeklinde sunacak şekilde düzenleyen bir LLM’ye aktarılır.

- Çıktı ve saklama: Elde edilen alanlar artık yapılandırılmış bir formatta, bir veritabanına eklenmeye veya gelecekte kullanmak üzere saklanmaya hazırdır.

Önizleme API’leri, karmaşık iş akışlarını oluşturmak için birden fazla model birleştirerek kolayca deneme yapmanızı sağlar. Demo arayüzünden, build.nvidia.com üzerinde bulunan farklı VLM’ler, OCR ve LLM modelleri arasında geçiş yapabilirsiniz. Bu, hızlı deneyler yapmanızı sağlar.

NV-DINOv2 ile Az Örnekle Sınıflandırma

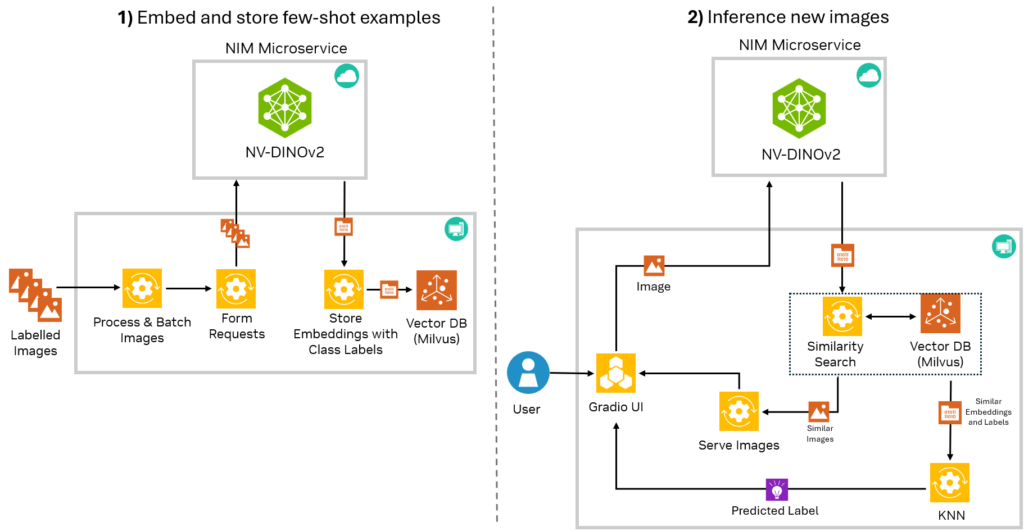

NV-DINOv2, yüksek çözünürlüklü görüntülerden gömmeler oluşturarak yalnızca birkaç örnekle detaylı analiz gerektiren görevler için idealdir; örneğin, yalnızca birkaç örnek görüntü ile kusur tespiti için kullanılabilir. Bu iş akışı, NV-DINOv2 ve Milvus vektör veritabanı kullanarak ölçeklenebilir bir çok az örnekle sınıflandırma boru hattı oluşturmanın nasıl yapılacağını gösteriyor.

Az örnekle sınıflandırma boru hattı şu şekilde çalışır:

- Sınıfları tanımlayın ve örnekleri yükleyin: Kullanıcılar sınıfları tanımlar ve her birine birkaç örnek görüntü yükler. NV-DINOv2, bu görüntülerden gömmeleri oluşturur ve bunları sınıf etiketleri ile birlikte Milvus vektör veritabanında depolar.

- Yeni sınıfları tahmin edin: Yeni bir görüntü yüklendiğinde, NV-DINOv2 kendi gömmesini oluşturur ve bu gömme, vektör veritabanında depolanan gömmelerle karşılaştırılır. En yakın komşular, k-en yakın komşu (k-NN) algoritmasını kullanarak belirlenir ve bunlar arasında çoğunluk sınıfı tahmin edilir.

NV-CLIP ile Çok Modlu Arama

NV-CLIP, hem metin hem de görüntüleri gömme işlemi yaparak çok modlu arama gerçekleştirme avantajı sunar. Metin ve görüntü girdilerini aynı vektör alanında gömerek, NV-CLIP belirli bir metin sorgusuyla eşleşen görüntüleri geri çağırmayı mümkün kılar. Bu, son derece esnek ve doğru arama sonuçları elde eder.

Bu iş akışında, kullanıcılar bir dizi görüntü yükler, bunlar gömülür ve bir vektör veritabanında depolanır. Kullanıcı arayüzünü kullanarak, bir sorgu yazar ve NV-CLIP, verilen metne dayalı en benzer görüntüleri geri döndürür.

Daha ileri düzey ajanlar, bu yaklaşım kullanılarak VLM’lerle birleştirilip çok modlu RAG iş akışları oluşturarak, görsel yapay zeka ajanlarının geçmiş deneyimlerden yararlanmasını ve yanıtlarını iyileştirmesini sağlar.

Görsel AI Ajanları ile Tanışmaya Hazır mısınız?

Kendi görsel yapay zeka ajanlarınızı oluşturmak için hemen başlayın! /NVIDIA/metropolis-nim-workflows GitHub deposundaki sağlanan kodları kullanarak özel iş akışlarınızı ve NIM mikro hizmetleri ile desteklenen AI çözümlerinizi geliştirin. Örneklerden ilham alarak spesifik sorunlarınızı çözmeye yardımcı olacak yeni uygulamalar geliştirin.

Herhangi bir teknik soru veya destek ihtiyacınız için, topluluğumuza katılabilir ve NVIDIA Görsel AI Ajan forumunda uzmanlarla etkileşimde bulunabilirsiniz.