Dijital İnsanlar, Ajanlar, Podcastler, Görüntü ve Video Üretimi gibi yeni kullanım alanlarıyla üretken yapay zeka, bilgisayarlarla olan etkileşim biçimimizi köklü bir şekilde değiştiriyor. Bu paradigma kayması, üretken yapay zeka modelleriyle etkileşim kurma ve programlama konusunda yeni yöntemler gerektiriyor. Ancak, özellikle bilgisayar geliştiricileri ve yapay zeka meraklıları için başlamak oldukça zorlayıcı olabilir.

Bugün, NVIDIA, NVIDIA RTX AI PC’lerde yapay zeka geliştirmeyi ve denemeyi hızlandırmak amacıyla bir dizi NVIDIA NIM mikroservisi piyasaya sürdü. Bu mikroservisler şu anda beta aşamasında ve dil, konuşma, animasyon, içerik üretimi ve görsel beceriler gibi AI temel modellerini sunuyor.

Kullanımı kolay olan endüstri standartlarına sahip API’ler, yapay zeka yolculuğunuzu hızlandırmanıza yardımcı oluyor. Bu API’ler, indirilmesi ve çalıştırılması son derece basit olan, PC geliştirme için en üst düzey modları kapsayan, ünlü ekosistem uygulamaları ve araçları ile uyumlu bir yapıda.

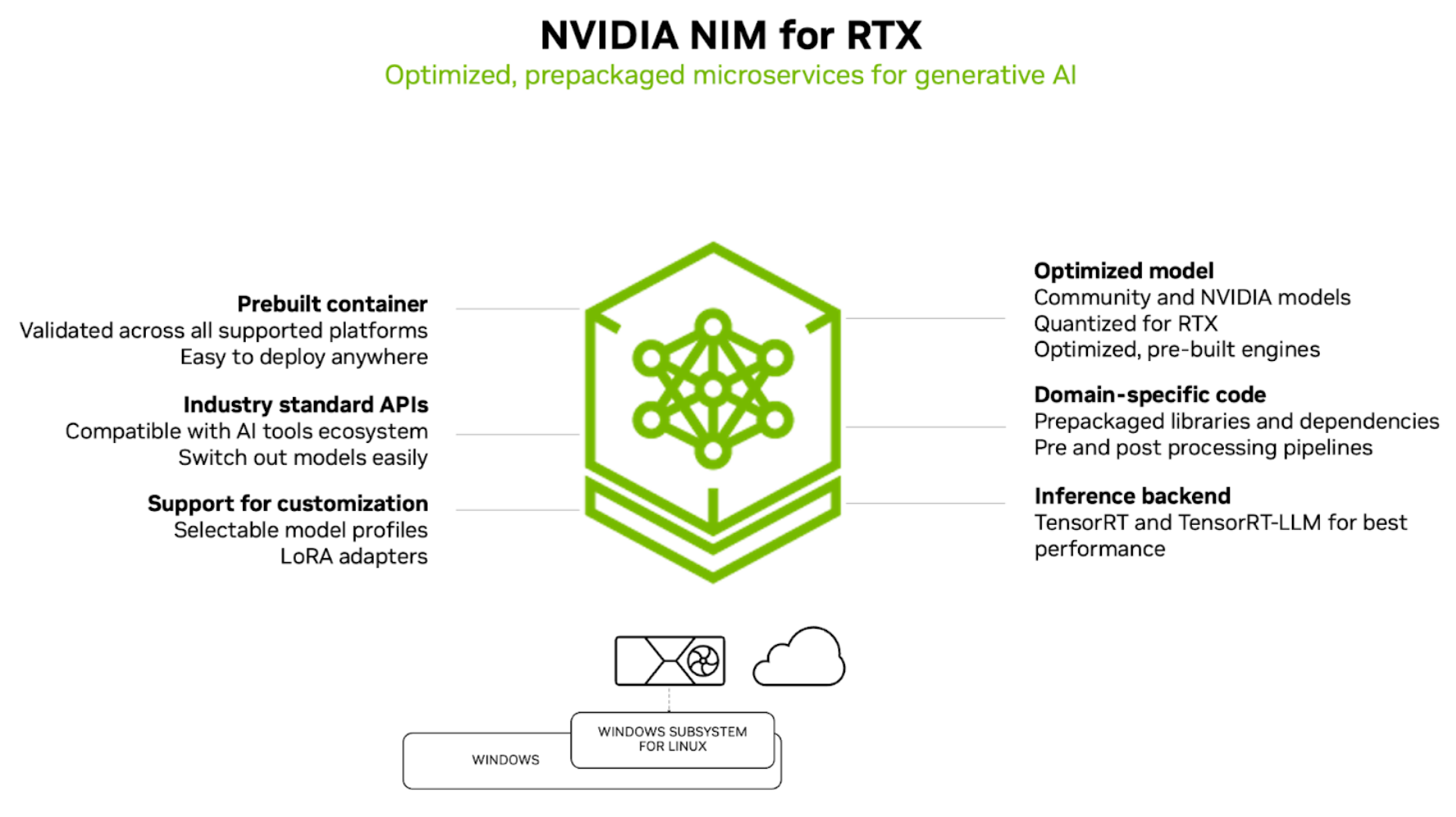

NVIDIA NIM Mikroservislerinin Çalışma Prensibi

Bilgisayar platformunda yapay zeka sunmak, benzersiz zorluklar getiriyor. Yapay zeka yazılım katmanı, kütüphaneler ve çerçevelerden SDK’lar ve modellere doğru hızla evrimleşiyor. Bu yazılım katmanlarının kombinasyon sayısı son derece büyük. Bu katmanlardan birindeki uyumsuzluk, tüm iş akışlarını etkileyerek bozulmasına yol açabiliyor. Ayrıca, yapay zekanın performansını bilgisayar üzerinde sağlamak için detaylı kaynak yönetimi ve katı gecikme ile bant genişliği gereksinimleri bulunuyor.

Geliştiriciler, bilgisayar ortamında modeller oluşturuyor, bu modelleri uygulama ihtiyaçlarına göre özelleştiriyor, bellek kaynaklarının daha verimli kullanılmasını sağlamak için bunları kuantize ediyor ve özel bilgisayara özgü çıkarım altyapılarına bağlıyorlar.

NIM, bu zorlukların üstesinden gelmeye yardımcı oluyor. NIM, NVIDIA GPU’larda dağıtım için optimize edilmiş, paketlenmiş, son teknoloji yapay zeka modelleri sunuyor. NIM mikroservisi, önceden eğitilmiş ve özelleştirilmiş yapay zeka modelleri için kendinize özel hızlandırılmış mikroservisler barındıracak şekilde bir konteyner olarak paketlenmiş. Ayrıca, NVIDIA TensorRT ve TensorRT-LLM gibi NVIDIA GPU’lar için önceden optimize edilmiş çıkarım motorlarıyla inşa edilmiştir.

NIM ile, standart API’ler ve NVIDIA platformları arasında bulut, veri merkezi, NVIDIA RTX AI PC ve iş istasyonunda birleşik bir geliştirme ve dağıtım deneyimi elde edersiniz.

GeForce RTX 50 Serisi GPU’lar, FP4 hesaplamasını desteklemekte olup 32 GB’a kadar VRAM ile birlikte gelir ve bu da yapay zeka çıkarım performansını 2 kat artırarak daha büyük üretken yapay zeka modellerinin yerel olarak çalıştırılmasını sağlar.

NIM mikroservisleri, ayrıca NVIDIA Blackwell mimarisi üzerine inşa edilen yeni NVIDIA GeForce RTX 50 Serisi GPU’lar için optimize edilmiştir.

NVIDIA RTX AI PC’lerde, NIM mikroservisleri WSL2 üzerinden çalıştırılır. NVIDIA ve Microsoft, CUDA hızlandırmasını WSL2’ye getirmek için iş birliği yaptı; bu sayede NIM mikroservislerini WSL2 üzerinde Podman konteyner takımı ve çalışma zamanı ile çalıştırmak mümkün hale geldi. Bu, AI iş yüklerinizi her yerde inşa etmenize, çalıştırmanıza, paylaşmanıza ve doğrulamanıza olanak tanır.

NVIDIA RTX AI PC’de NIM Mikroservislerine Başlayın

NVIDIA RTX AI PC’ler için sunulan yeni NIM mikroservisleri, LLM’ler, VLM’ler, görüntü üretimi, konuşma, RAG için gömme modelleri, PDF çıkarma ve bilgisayarlı görme gibi kullanım alanlarını kapsıyor.

- Dil ve akıl yürütme:

- Görüntü Üretimi: Flux.dev

- Ses:

- RAG:Llama-3.2-NV-EmbedQA-1B-v2

- Bilgisayarlı Görme ve Anlama:NV-CLIP, PaddleOCR, Yolo-X-v1

NIM mikroservislerine PC’de başlamak için birkaç yol bulunmaktadır:

- NVIDIA API Kataloğu’ndan indirin

- Diğer çerçevelerle entegre edin

- NVIDIA RTX AI PC ara yüzlerini kullanın

NVIDIA API Kataloğu

NIM mikroservislerini indirin, yükleyin ve çalıştırın.

Microservisinizi seçin ve Yayınla seçeneğini seçin. Hedef ortam için Windows on RTX AI PCs (Beta)‘yı seçin.

Diğer Çerçevelerle Entegre Olun

Düşük kodlu ve kodsuz araçlar da dahil olmak üzere uygulama geliştirme araçları ve çerçeveleri ile entegre olabilirsiniz:

Bu native entegrasyonlar ile bu çerçeveler üzerinde inşa edilmiş iş akışlarınızı NIM’de çalışan yapay zeka modellerine bağlayabilir, bulut, veri merkezi, iş istasyonu ve PC arasında standart bir arayüz kullanarak en son teknolojiyi kullanabilirsiniz.

Örneğin, Flowise’de NIM mikroservislerine erişmek için şu adımları izleyebilirsiniz:

- Flowise’de Chat Modelleri‘ni seçin ve Chat NVIDIA NIM düğmesini tahtaya sürükleyin.

- NIM’yi Yerel Olarak Kur seçeneğini belirleyin ve NIM yükleyicisini indirin.

- İndirme tamamlandıktan sonra bir modeli seçin ve İleri‘yi tıklayın.

- Model indirilince, bellek kısıtlamalarını yapılandırın ve mikroservisi çalıştırmak için kullanılmayan bir anahtar bağlantı noktasını ayarlayın.

- Konteyneri başlatın, sohbet akışını kaydedin ve sohbet penceresinde istemde bulunun.

NVIDIA RTX AI PC Ara Yüzlerini Kullanın

NIM’i NVIDIA RTX AI PC’lerde kullanıcı dostu ara yüzler aracılığıyla deneyimleyin:

Örneğin, AnythingLLM ile NIM’i şu şekilde kullanabilirsiniz:

- AnythingLLM’de Yapılandır > AI Sağlayıcıları > LLM‘yi seçin.

- Sağlayıcı altında NVIDIA NIM‘ı seçin ve NVIDIA NIM Yükleyicisini Çalıştır seçeneğini belirleyin.

- NVIDIA yükleyicisi tamamlandığında Yönetilen Mod’a Geç seçeneğini seçin.

- NVIDIA’dan NIM’leri İçe Aktar seçeneğini seçin, bir model seçin ve kullanım şartlarını kabul edin.

- Seçilen NIM modelini aktif durumuna getirin, NIM’i Başlat seçeneğini seçin ve iş alanlarına geri dönün.

- Yeni bir sohbete açın ve istemde bulunun.

Video 1. RTX üzerinde Son Teknoloji LLM’leri Çalıştırma | NVIDIA NIM x AnythingLLM

NIM’i Microsoft AI Toolkit for VS Code ile kullanmak için şu adımları izleyebilirsiniz:

- NVIDIA NIM Yükleyicisini kullanarak NIM mikroservisleri için ortamı kurun.

- Visual Studio Code’daki AI Toolkit uzantı sekmesinde Model kataloğu‘nu seçin.

- Mevcut modelleri görüntülemek için Barındıran > NVIDIA NIM‘ı seçin.

- Bir model indirmek için Ekle seçeneğine tıklayın. Tamamlandıktan sonra Oyun Alanı > Model seçimi‘ni seçin ve NIM’i yerel olarak başlatın. Model yüklendiğinde, AI Toolkit üzerindeki mikroservis çalışmaya hazırdır.

NIM mikroservislerini ChatRTX ile nasıl kullanacağınıza dair kullanıcı kılavuzunu inceleyebilirsiniz.

NIM İle AI Mühendislik Şablonları ile Gücü Deneyimleyin

Yakında, NVIDIA RTX AI PC’lerde NVIDIA AI Mühendislik Şablonları, NIM mikroservisleri ile üretken yapay zeka iş akışları oluşturmanıza hızlı bir başlangıç sağlayacak. Bu mühendislik şablonları, her şeyi içeren referans örnekleri olarak işlev görecek ve bu sayede NIM mikroservisleri, örnek kod ve dokümantasyon ile gelişmiş yapay zeka iş akışları yerel olarak oluşturulacak. Üstelik, bu şablonlar modüler yapıda olup çeşitli kullanım alanları için hızlı bir şekilde tamamen özelleştirilebilir.

Örnek mühendislik şablonları şunlardır:

- PDF’den Podcast’e: Belgeleri sesli içeriğe dönüştürerek hareket halindeyken öğrenmenizi sağlar. PDF’den metin, görüntü ve tablo çıkarır. AI tarafından üretilen senaryo temelinde, mevcut sesler kullanılarak tam bir podcast üretebilir. Kullanıcılar, belirli konular hakkında daha fazla bilgi almak için podcast sunucuları ile gerçek zamanlı sohbet gerçekleştirebilirler.

- 3D Rehberli Üretken AI: Görüntü üretimi üzerinde tam kontrol sağlar. Flux görüntü modelleri ve Blender’a benzer bir 3D render uygulaması ile sahne unsurlarını tanımlayabilir, kamera açısını ayarlayabilir ve yüksek kaliteli görseller elde etmek için AI’dan faydalanabilirsiniz. Bu iş akışı, Flux NIM mikroservisi, Flux.dev modelleri ve ComfyUI ile birleştirilmiş olup tek tıklama ile kurulumu kolaydır.

Özet

Geliştirme ve deneyim için, NVIDIA NIM ile NVIDIA RTX AI PC’de başlayın.

Geliştirici topluluğuna katılmak için NVIDIA Geliştirici Discord topluluğuna katılın. Teknik destek almak için, sorularınızı yanıtlamak üzere NVIDIA Geliştiriciler Forumlarını ziyaret edin.