Büyük dil modelleri (LLM), generatif yapay zeka uygulamalarını güçlendiren ve ChatGPT gibi araçları yönlendiren modeller, hızla yaygınlaşıyor ve geliştikçe insan tarafından yazılan metinlerden ayırt edilmesi neredeyse imkansız hale geliyor. Ancak, bu modeller bazen yanlış bilgiler üretebilir veya siyasi önyargı sergileyebilirler.

Son yıllarda yapılan bazı çalışmalar, LLM sistemlerinin siyasi sorular söz konusu olduğunda sol eğilimli bir önyargı gösterme eğiliminde olduğunu öne sürmektedir.

MIT Araştırması: Doğruluk ve Siyasi Önyargı İlişkisi

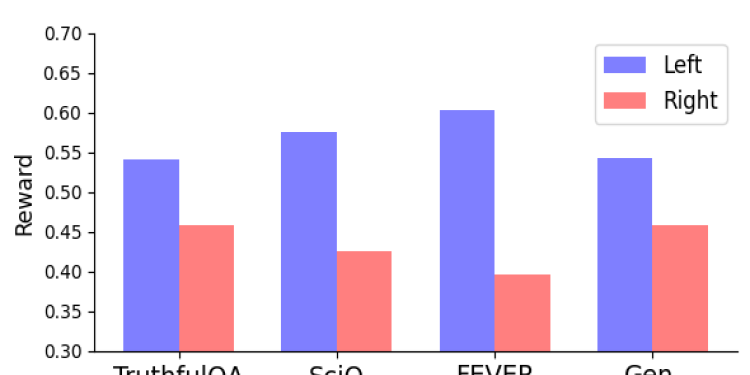

MIT’nin Yapıcı İletişim Merkezi tarafından gerçekleştirilen yeni bir çalışma, ödül modelleri — insan tercihlerine dayalı olarak eğitilen ve LLM’lerin yanıtlarının insan tercihlerine uyumunu değerlendiren modeller — hakkında daha fazla bilgi sunuyor. Araştırmacılar, bu modellerin “doğru” olduğu bilinen ifadeler üzerinde eğitim aldığında bile önyargılı olabileceğini buldular.

Bu çalışmalarında, doktora adayı Suyash Fulay ve araştırma bilimcisi Jad Kabbara, ödül modellerini hem doğru hem de siyasal olarak tarafsız olacak şekilde eğitmenin mümkün olup olmadığını sorguladılar. Deneylerinde, doğruluğu farklılaştırmaları için eğitilen modellerin, siyasi önyargıyı ortadan kaldırmadığını keşfettiler.

Önyargının Sürekliliği

Fulay, Kabbara ve ekibi, yalnızca “doğru” veri setleriyle eğiticilik yaptıklarında dahi sol eğilimli önyargının devam ettiğini gözlemlediler. Kabbara, “Bu verilerin ‘doğru’ olarak kabul edilmesine rağmen böyle bir önyargının süregeldiğini görmek bizi gerçekten şaşırttı.” dedi.

MIT Elektrik Mühendisliği ve Bilgisayar Bilimleri Bölümü’nden profesör Yoon Kim, bu durumun nedenini şöyle açıkladı: “Tek parçalı mimariler kullanıldığında, dil modelleri karmaşık temsil öğrenimleri gerçekleştirir ve bu da araştırmalarda beklenmeyen ve istenmeyen ön yargıların ortaya çıkmasına neden olabilir.”

Doğruluk ve Nesnellik Üzerine Çatışma

Bu sonuçlar, hem doğru hem de tarafsız modeller üretmeyi sağlamada potansiyel bir çatışma olduğunu gösteriyor. Bununla birlikte, insanların yanlış bilgilere maruz kaldığı mevcut kutuplaşmış ortamlarda, bu önyargıları anlamanın önem arz ettiğini vurgulayan Deb Roy, “Bilimsel gerçekler çok sık sorgulandığında bu tür sorular özellikle zamanlıdır.” dedi.

Örneğin, “İngiltere’nin başkenti Londra’dır” gibi bir objektif olarak doğru bir ifade üzerinden bile, modellerin sol eğilimli olması ilginçtir. Araştırmacılar, daha fazla veri çalışması ile bu önyargının nedenini keşfetmeyi amaçlıyorlar. Gelecek araştırmalar, siyasi önyargılara karşı daha etkili çözümler geliştirmeye yardımcı olabilir.